Wiadomość została wysłana.

Przetworzymy Twoją prośbę i skontaktujemy się z Tobą tak szybko, jak to możliwe.

Formularz został pomyślnie przesłany.

Więcej informacji można znaleźć w skrzynce pocztowej.

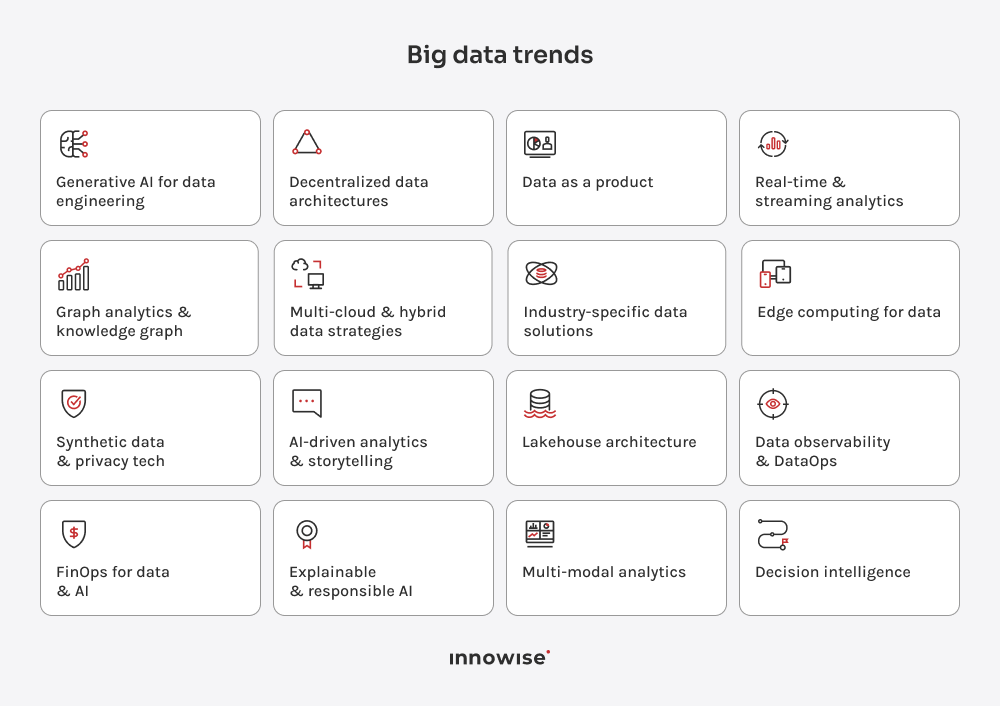

Zacznę od odważnego stwierdzenia: 2026 to rok rozliczeń dla dużych przemysł danych. Spędziliśmy ostatnią dekadę eksperymentując z każdą nową, błyszczącą technologią pod słońcem: AI, IoT, platformy chmurowe i wszystkie te modne hasła. Ale zgadnij co? Nadszedł czas, aby się postawić, albo przegapisz łódź. Jeśli Twoja firma jeszcze nie wymyśliła, jak przekształcić ten ogromny zalew danych w coś użytecznego, zostaniesz w tyle.

2026 to czas, aby wykorzystać te narzędzia i wyprzedzić konkurencję. Jesteś ciekawy, które trendy warto obserwować? Zanurzmy się w nie.

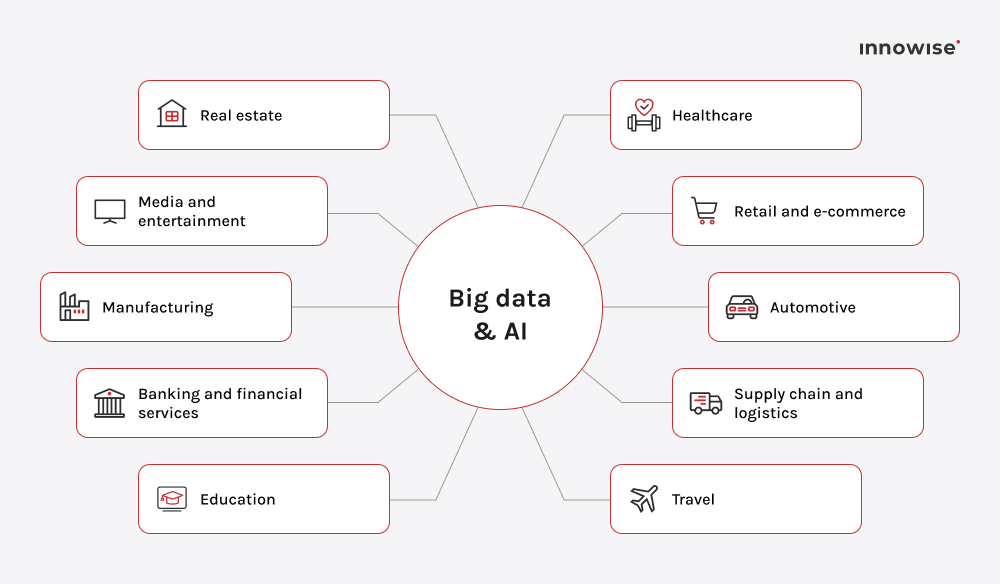

W 2026, Big Data staje się kluczowym czynnikiem napędzającym wartość biznesową i ma wpływ na każdą branżę. Od kopilotów analitycznych napędzanych przez AI po przetwarzanie brzegowe w czasie rzeczywistym, trendy te definiują przyszłość big data które już się rozwijają. Będą one kształtować sukces Twojej firmy, więc przeczytaj ten artykuł do końca.

Jeden z najbardziej wpływowych przyszłe trendy w analityce dużych zbiorów danych jest rozwój generatywnego AI. Chociaż nie jest jeszcze doskonały, GenAI już teraz zajmuje się najbardziej czasochłonnymi i żmudnymi częściami inżynierii danych. AI nie wyeliminuje całkowicie wyzwań związanych z jakością danych, ale może znacznie zmniejszyć liczbę godzin spędzanych przez zespół na przygotowywaniu danych.

AI jest obecnie wbudowany w potoki danych, zdolne do automatyzacji zadań, takich jak czyszczenie danych, wypełnianie brakujących luk (imputacja) i przekształcanie danych. Oznacza to, że będziesz mieć czyste, gotowe do użycia dane w ułamku czasu. Na przykład platformy takie jak Databricks i Snowflake zawierają już wbudowaną funkcjonalność dla potoków generatywnych z obsługą AI. Pomaga to organizacjom zautomatyzować transformację danych, wypełnianie luk i dostarczanie zestawów danych gotowych do AI.

Wskazówka:

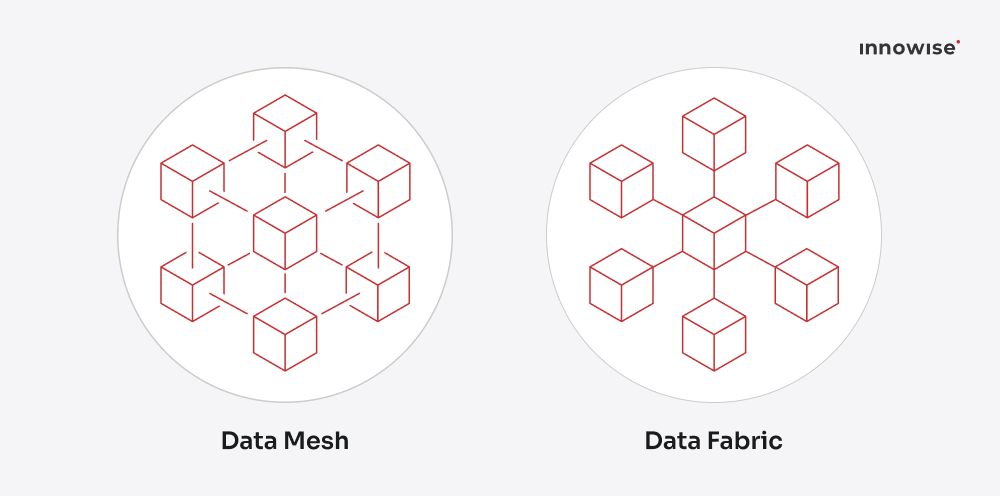

Poleganie na przestarzałych architekturach danych będzie Cię powstrzymywać. Kluczem do utrzymania konkurencyjności jest wdrożenie Data Mesh i Data Fabric.

Data Mesh decentralizuje własność danych, pozwalając zespołom domenowym zarządzać i obsługiwać własne dane, eliminując wąskie gardło centralnego IT. Data Fabric łączy wszystkie źródła danych (w chmurze, lokalne, brzegowe) w spójny system z automatycznymi metadanymi, linią i integracją. Razem tworzą skalowalną, elastyczną architekturę, która umożliwia zwinność bez poświęcania kontroli.

Rozwój rynku siatek danych (ma osiągnąć $5,09 mld do 2032 r.) pokazuje, jak szybko firmy przechodzą na zdecentralizowane modele danych.

Wskazówka:

Podczas gdy Data Mesh definiuje architektura W przypadku decentralizacji działa ona najlepiej w połączeniu z podejściem “dane jako produkt”, w którym każdy zbiór danych jest własnością, jest udokumentowany i zarządzany jak prawdziwy produkt.

Data Mesh zapewnia strukturę. Data as a Product zapewnia dyscyplinę. W 2026, Inteligentne firmy nie tylko decentralizują dane, ale zarządzają nimi jak produktem, z jasną własnością, dokumentacją i mierzalną wartością. Podczas gdy wiele firm nadal pracuje nad centralizacją swoich danych, trend szybko odchodzi od danych zakopanych w przypadkowych arkuszach kalkulacyjnych lub odizolowanych bazach danych. W podejściu do danych jako produktu, każdy zbiór danych posiada dokumentację, przypisanie ról, umowy o poziomie usług i pętlę informacji zwrotnej w celu poprawy.

W ten sposób marketing wie, gdzie znajdują się dane ich kampanii. Finanse ufają liczbom przychodów bez potrzeby “dnia uzgadniania danych”. A inżynieria wreszcie przestaje działać jako wąskie gardło między pulpitami nawigacyjnymi wszystkich innych.

Platformy takie jak Snowflake Data Cloud i Databricks Marketplace już teraz pomagają zespołom publikować, udostępniać, a nawet zarabiać na produktach danych wewnętrznie lub z partnerami. Otwiera to nowe możliwości współpracy i nowe źródła przychodów. Zwłaszcza, gdy “produkt danych” staje się czymś, co inni chcą kupić lub wykorzystać.

Wskazówka:

"W Innowise zawsze upewniamy się, że dane pracują dla Ciebie w sposób praktyczny i wydajny. Nasze podejście integruje AI, automatyzuje przepływy danych i umożliwia wgląd w czasie rzeczywistym, dzięki czemu Twój zespół nie jest ograniczony złożonością. Otrzymujesz czyste, przydatne dane wtedy, gdy ich potrzebujesz, dzięki czemu możesz podejmować decyzje w oparciu o fakty..

Dyrektor ds. technologii

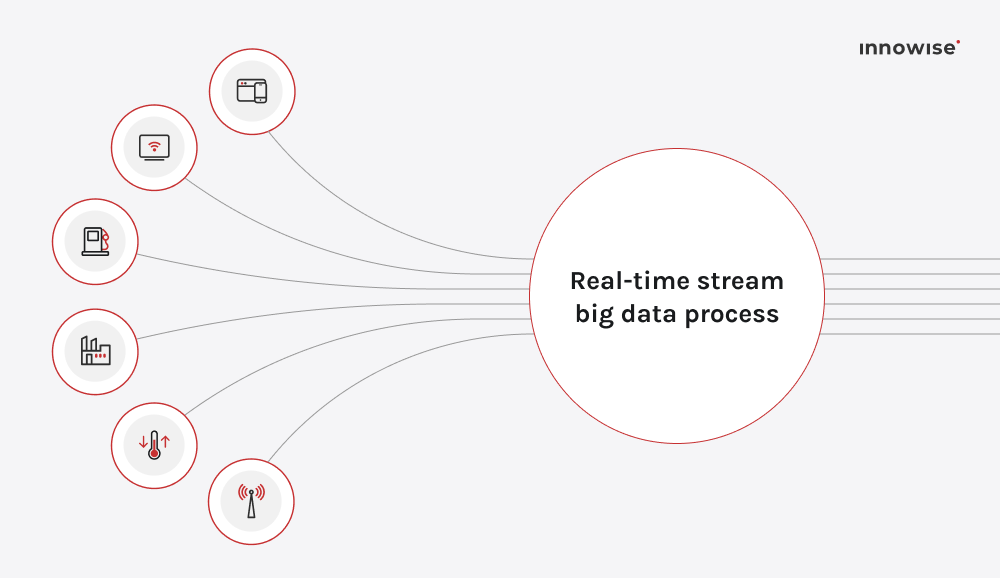

Następny na liście przyszłe trendy w big data to Analityka w czasie rzeczywistym. Chociaż koncepcja ta jest rozwijana od lat, do 2026 r. będzie ona szybko ewoluować z przewagi konkurencyjnej w podstawowa konieczność dla organizacji, które wymagają natychmiastowego wglądu w dane. Przetwarzanie danych w momencie ich napływu, zamiast oczekiwania na partie, odblokowuje możliwość działania na podstawie zdarzeń, sygnałów i wzorców jak to się dzieje. Dla obszaru big data oznacza to strumieniowe źródła danych o dużej objętości (czujniki IoT, interakcje użytkowników, dzienniki) za pośrednictwem potoków, które analizują i reagują w ciągu sekund lub milisekund.

Rynek wspiera tę zmianę. Globalny sektor analityki strumieniowej został wyceniony na $23,4 mld w 2023 r. i przewiduje się, że wzrośnie do około $ 128,4 mld EUR do 2030 r., przy CAGR około 28,3% w latach 2024-2030. Branże takie jak finanse, telekomunikacja, produkcja i handel detaliczny już wykorzystują modele strumieniowe do wykrywania oszustw, dynamicznego ustalania cen, konserwacji predykcyjnej i optymalizacji obsługi klienta.

Wskazówka:

Jeśli Twoja strategia dotycząca danych nadal traktuje czas rzeczywisty jako “dodatek” i w pierwszej kolejności koncentruje się na danych wsadowych, 2026 podkreśli lukę, uwierz mi.

Analityka grafowa wkracza w centrum uwagi w 2026 roku, nie jako nowa technologia, ale dlatego, że jej przyjęcie jest gwałtownie przyspieszane przez integrację AI. Zamiast traktować dane wyłącznie jako wiersze i kolumny, organizacje wykorzystują wykresy, aby zrozumieć, w jaki sposób podmioty łączą się ze sobą: klienci, produkty, węzły czujników, pierścienie oszustw, można to nazwać. Wykresy wiedzy i bazy danych grafów sprawiają, że jest to możliwe: mapują złożone relacje i ujawniają spostrzeżenia, które tradycyjne metody mają trudności z ujawnieniem. Na przykład Najnowszy raport bazy danych wykresów opracowany przez Verified Market Reports wyjaśnia że grafowe bazy danych mają obecnie kluczowe znaczenie dla przetwarzania w czasie rzeczywistym, relacji semantycznych i wykrywania anomalii w oparciu o AI.

Dla liderów biznesu kluczowa korzyść jest następująca: odkrywasz dlaczego rzeczy się dzieją, nie tylko , który się zdarzają. W przypadku wykrywania oszustw, wykrywasz sieć podmiotów; w przypadku rekomendacji, mapujesz ukryte powiązania; w przypadku IoT, śledzisz łańcuchy awarii. Ta moc przynosi głębszy wgląd, szybsze wykrywaniei bardziej strategiczne działania.

Wskazówka:

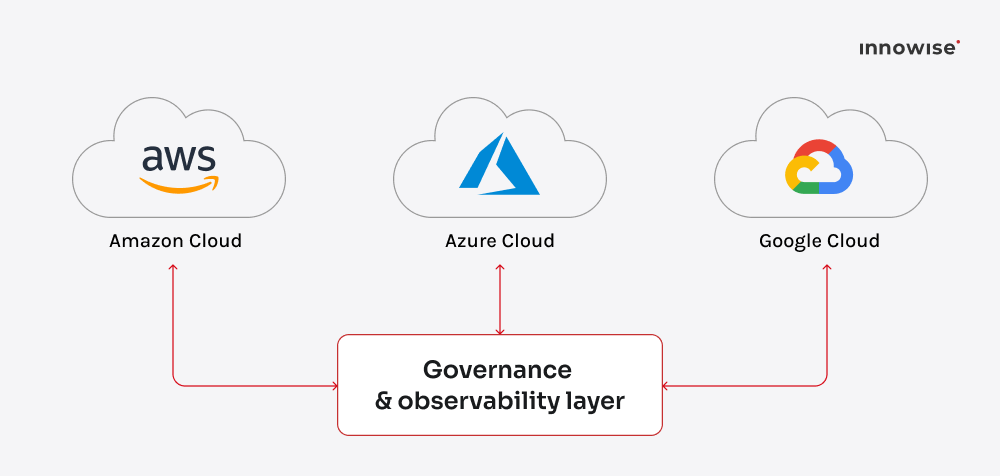

W 2026 r. poleganie wyłącznie na jednym dostawcy usług w chmurze jest coraz częściej postrzegane jako ryzyko, podobnie jak inwestowanie wszystkich środków w jedną akcję. Podczas gdy wiele organizacji nadal korzysta głównie z jednej platformy, najbardziej zaawansowane strategicznie firmy grają obecnie w grę wielochmurową. Równoważą one usługi z AWS, Azure i Google Cloud, aby uniknąć uzależnienia i wycisnąć z każdej z nich najlepszy stosunek wydajności do kosztów.

Rośnie również liczba konfiguracji hybrydowych. Organizacje łączą w nich usługi chmurowe z istniejącymi lokalnymi centrami danych. Powody tego hybrydowego podejścia są głębsze niż tylko utrzymywanie wrażliwych danych na miejscu:

Haczyk? Złożoność. Rozprzestrzenianie obciążeń w chmurach wprowadza więcej ruchomych części: różne interfejsy API, systemy rozliczeniowe i zasady zarządzania. Zwycięzcami są ci, którzy zautomatyzują warstwę orkiestracji i monitorowania. Pomyśl o silnikach zapytań między chmurami, ujednoliconym zarządzaniu tożsamością i narzędziach obserwacyjnych, które śledzą opóźnienia i koszty w czasie rzeczywistym.

Wskazówka:

Ogólne platformy danych są świetne. Dopóki nie zaczną rozwiązywać niczego konkretnego. Właśnie dlatego w 2026, Firmy działające w bardzo konkurencyjnych, obarczonych wysokim ryzykiem lub regulowanych obszarach mają dość ogólnych narzędzi. Chcą rozwiązań dostosowanych do branży, które mówią ich językiem, obsługują ich przepisy i zapewniają wyniki zamiast pulpitów nawigacyjnych, które wyglądają imponująco i niewiele znaczą.

Dlaczego więc firmy nagle domagają się tych specjalistycznych rozwiązań w 2026? Tak naprawdę sprowadza się to do trzech dużych rzeczy:

Zespoły opieki zdrowotnej chcą analityki predykcyjnej które pomagają lekarzom dostrzec zagrożenia dla pacjentów, zanim dojdzie do ich eskalacji. Bankom zależy na wykrywaniu oszustw, scoring ryzyka i hiper-spersonalizowane oferty. Producenci śledzą stan sprzętu i widoczność łańcucha dostaw z dokładnością co do minuty. Oraz detaliści łączą dane transakcyjne z czujnikami w sklepie i trendami społecznymi, aby prognozować popyt bez zaglądania do arkuszy kalkulacyjnych.

Dlatego też rynek przesuwa się w kierunku produkty danych specyficzne dla domeny: gotowe modele, konektory i ramy zgodności, które pasują bezpośrednio do rzeczywistych przepływów pracy. Ta specjalizacja już teraz wykazuje ogromny wzrost na rynkach wertykalnych. Na przykład, według Visiongain, firma sam rynek analityki medycznej osiągnie $101 miliardów do 2031 r., napędzany przez tego rodzaju specjalizację.

Wskazówka:

W 2026, Zapotrzebowanie na natychmiastowe, zautomatyzowane działania jest najważniejsze. Chociaż chmura jest nadal niezbędna, firmy zdają sobie sprawę, że wysyłanie danych kosztuje zbyt wiele czasu i pieniędzy. każdy pojedynczy bajt danych do odległego serwera w celu ich przetworzenia.

Edge computing jest rozwiązaniem. Przybliża przetwarzanie danych do miejsca ich generowania: czujników, maszyn, urządzeń, a nawet samochodów. Zamiast przesyłać terabajty przez sieć, przetwarzasz ważne rzeczy lokalnie i działasz natychmiast.

Dlaczego ten trend eksploduje? teraz?

Ma to największe znaczenie dla branż, w których liczy się szybkość: inteligentnych fabryk, które na bieżąco dostosowują linie produkcyjne, szpitali, które monitorują pacjentów w czasie rzeczywistym lub sieci detalicznych, które dynamicznie zarządzają cenami w oparciu o lokalny popyt. A za tym idą pieniądze: Prognozy IDC globalne wydatki na rozwiązania edge computing będą rosły w tempie ~13,8% CAGR i osiągną prawie $380 mld euro do 2028 r..

Najmądrzejsze organizacje nie zastępują chmury, ale ją uzupełniają. Używają konfiguracji hybrydowej: lokalne przetwarzanie dla szybkości, przechowywanie w chmurze dla skali. Rezultat jest piękny: mniejsze opóźnienia, niższe koszty przepustowości i szybsze decyzje, które faktycznie poruszają igłę.

Wskazówka:

W 2026, Dostęp do rzeczywistych danych jest trudniejszy niż kiedykolwiek: przepisy dotyczące prywatności są bardziej rygorystyczne, organy regulacyjne są czujne, a użytkownicy są znacznie mniej wyrozumiali. Dlatego potrzebujemy dane syntetyczne.

Trend ten eksploduje teraz, ponieważ Wysięgnik GenAI sprawiła, że syntetyczne dane są wystarczająco wysokiej jakości, aby niezawodnie naśladować złożone informacje ze świata rzeczywistego. Firmy coraz częściej polegają na tych sztucznych, statystycznie dokładnych danych, aby trenować ogromne modele AI szybciej i taniej niż tradycyjne metody, jednocześnie automatycznie spełniając surowe wymogi zgodności, takie jak RODO i unijna ustawa AI.

Narzędzia danych syntetycznych są wszędzie: od firm finansowych szkolących modele wykrywania oszustw po firmy medyczne prowadzące diagnostykę AI bez ujawniania danych pacjentów. Gartner oczekuje do 2030 roku, Dane syntetyczne przewyższą dane rzeczywiste w treningu AI, ponieważ jest bezpieczniejsza, szybsza i łatwiejsza do skalowania.

Wskazówka:

W 2026, Analityka wreszcie staje się ludzka. Copiloty AI i narzędzia do wizualizacji narracyjnej przekształcają teraz dane w przejrzyste historie zamiast niekończących się wykresów. Narzędzia takie jak Power BI Copilot, Tableau GPT, camelAI, a warstwa GenAI firmy Looker może wysyłać zapytania, podsumowywać i wyjaśniać spostrzeżenia w prostym języku.

Pomyśl o nich jak o analitykach danych. Możesz zapytać: “Jak kształtowały się przychody w tym kwartale?” lub “Która kampania przyniosła najwyższy zwrot z inwestycji?” i uzyskać natychmiastowe odpowiedzi w prostym języku. Narzędzia takie jak Power BI Copilot, Tableau GPTi camelAI Już to robimy, łącząc duże modele językowe bezpośrednio z danymi firmy.

Wskazówka:

W 2026, Granica między jeziorami danych a hurtowniami zatarła się. Nowy standard to lakehouse architecture, który jest modelem hybrydowym łączącym skalowalność jezior danych ze strukturą i wydajnością hurtowni. Można w nim przechowywać nieustrukturyzowane dane, wykonywać zapytania SQL i uruchamiać obciążenia związane z uczeniem maszynowym. Wszystko w jednym miejscu. Bez konieczności korzystania z dziesięciu różnych platform.

Sprzedawcy tacy jak Databricks, Snowflakei Google BigQuery są tutaj liderem.

Wskazówka:

W 2026, Zarządzanie potokami danych bez możliwości obserwacji jest jak latanie samolotem z wyłączoną deską rozdzielczą. Możesz poruszać się szybko, ale nie masz pojęcia, co się dzieje. Obserwowalność danych to sposób, w jaki zespoły uzyskują wgląd w kondycję, świeżość i niezawodność swoich danych. Informuje, kiedy coś jest nie tak, dlaczego tak się stało i jak to naprawić, zanim pulpity nawigacyjne zaczną pokazywać bzdury.

Dlaczego jest to niezbędne? teraz? Ponieważ bez tego nie ma zarządzania ani zgodności.

Idzie to w parze z DataOps, która automatyzuje takie czynności jak testowanie i wdrażanie. Razem, obserwowalność i DataOps zapewniają niezawodny, zgodny z przepisami i solidny szkielet danych z mniejszą liczbą niespodzianek i szybszym czasem odzyskiwania.

Wskazówka:

Czy rachunki za chmurę kiedykolwiek spędzały Ci sen z powiek? W miarę eksplozji ilości danych i mnożenia się obciążeń AI, FinOps (operacje finansowe dla chmury i danych) staje się niezbędna. Cel jest prosty: zrozumieć, gdzie trafia każdy dolar w ekosystemie danych i upewnić się, że faktycznie kupuje on wartość biznesową, a nie tylko większe serwery.

Trenowanie dużych modeli, przechowywanie petabajtów danych i uruchamianie niekończących się zapytań może szybko wyczerpać budżet. Zespoły FinOps wykorzystują teraz analitykę i automatyzację do śledzenie kosztów w czasie rzeczywistym, wykrywać nieefektywności i prognozować wykorzystanie w różnych działach. Dostawcy Cloud oferują nawet natywne narzędzia do tego celu (AWS Cost Explorer, Google Cloud Billing, Azure Cost Management), ale prawdziwe korzyści płyną z integracji wskaźników finansowych bezpośrednio z przepływami danych.

Wskazówka:

W 2026, AI prowadzi tak dużą część działalności, że “po prostu zaufaj modelowi” już nie działa. Zarządy, organy regulacyjne i klienci oczekują przejrzystość. Chcą wiedzieć dlaczego algorytm podjął decyzję, a nie tylko wynik. Dlatego Explainable AI (XAI) i Odpowiedzialny AI zyskują na popularności. Razem sprawiają one, że uczenie maszynowe staje się mniej czarną skrzynką, a bardziej systemem, którym można zarządzać.

Banki już korzystają z modeli, które można wyjaśnić aby uzasadnić decyzje kredytowe audytorom. Polegają na nich pracownicy służby zdrowia aby pokazać, w jaki sposób algorytmy diagnostyczne wyciągają wnioski. Nawet systemy HR są poddawane kontroli w celu udowodnienia uczciwości w rekomendacjach dotyczących zatrudniania. Gdy decyzje mają wpływ na ludzi lub zyski, ślepa wiara w AI nie jest strategią; to ryzyko.

Wskazówka:

Do 2026 r, rozwój big data wykroczy poza tabele i pulpity nawigacyjne, wkraczając w nową erę analizy multimodalnej. Tutaj tekst, obrazy, wideo i dane z czujników łączą się, tworząc kompletny, bogaty w kontekst obraz. Zamiast oddzielnie analizować opinie klientów i liczby sprzedaży, zespoły mogą teraz korelować transkrypcje połączeń, zdjęcia produktów i zachowania użytkowników w jednym obszarze roboczym.

Brzmi jak science-fiction, prawda? Ale platformy takie jak Databricks MosaicML, Claude dla danych Anthropici GPT-4 Turbo z wizją OpenAI obsługuje już wieloformatowe dane wejściowe. Rezultat jest świetny. Bogate w kontekst spostrzeżenia są niemal intuicyjne. Wyobraź sobie przewidywanie awarii sprzętu poprzez analizę krzyżową dzienników drgań, obrazów termicznych i notatek z konserwacji. To właśnie umożliwia analiza multimodalna.

Wskazówka:

I ostatni na liście kluczowe trendy w big data są inteligencja decyzyjna (DI). Jest to łączy naukę o danych, i logiki biznesowej, aby pomóc organizacjom w szybszym podejmowaniu mądrzejszych decyzji. Zamiast rzucać setkami wskaźników, systemy DI modelują, w jaki sposób wybory prowadzą do wyników, a następnie symulują scenariusze przed podjęciem decyzji.

Potraktuj to jako analitykę, która odpowiada na “Co się stanie, jeśli faktycznie to zrobimy?”.”, nie tylko “Co się stało w ostatnim kwartale?” Detaliści używają go do testowania strategii cenowych przed ich wdrożeniem. Banki używają go do symulacji ekspozycji na ryzyko w portfelach. Nawet zespoły HR używają DI do przewidywania wpływu na zatrudnianie i zatrzymywanie pracowników przed wdrożeniem polityki.

Rynek potwierdza tę zmianę: globalny rynek inteligencji decyzyjnej szacowano na $15,22 mld euro w 2024 roku i przewiduje się, że osiągnie $36,34 mld euro do 2030 r., rosnąc w tempie około 15,4% CAGR.

Wskazówka:

Jaka jest zatem przyszłość big data? 2026 przynosi nowy poziom dojrzałości. Obecnie nacisk kładziony jest na wybór narzędzi i metod, które faktycznie wywierają wpływ. Firmy, które łączą technologię z jasnymi celami, odnotują szybszy wzrost i lepsze wyniki.

Używaj AI tam, gdzie oszczędza to czas i poprawia dokładność. Zbuduj siatkę danych, która pomaga zespołom pracować razem, a nie w silosach. Zainwestuj w analitykę w czasie rzeczywistym, która pomoże Ci działać we właściwym momencie, a nie po fakcie.

Liderzy tego roku rozumieją jedno: wartość wynika z celowego stosowania danych. Wybierz to, co pasuje do Twojej strategii, spraw, by działało w różnych zespołach i pozwól, by dane stały się motorem napędzającym każdy Twój inteligentny ruch.

Kierownik działu Big Data i AI

Philip skupia się na wszystkich kwestiach związanych z danymi i AI. To on zadaje właściwe pytania na wczesnym etapie, wyznacza silną wizję techniczną i upewnia się, że nie tylko budujemy inteligentne systemy - budujemy właściwe, dla prawdziwej wartości biznesowej.

Wiadomość została wysłana.

Przetworzymy Twoją prośbę i skontaktujemy się z Tobą tak szybko, jak to możliwe.

Rejestrując się, wyrażasz zgodę na naszą Politykę Prywatności, w tym korzystanie z plików cookie i przekazywanie Twoich danych osobowych.