Uw bericht is verzonden.

We verwerken je aanvraag en nemen zo snel mogelijk contact met je op.

Het formulier is succesvol verzonden.

Meer informatie vindt u in uw mailbox.

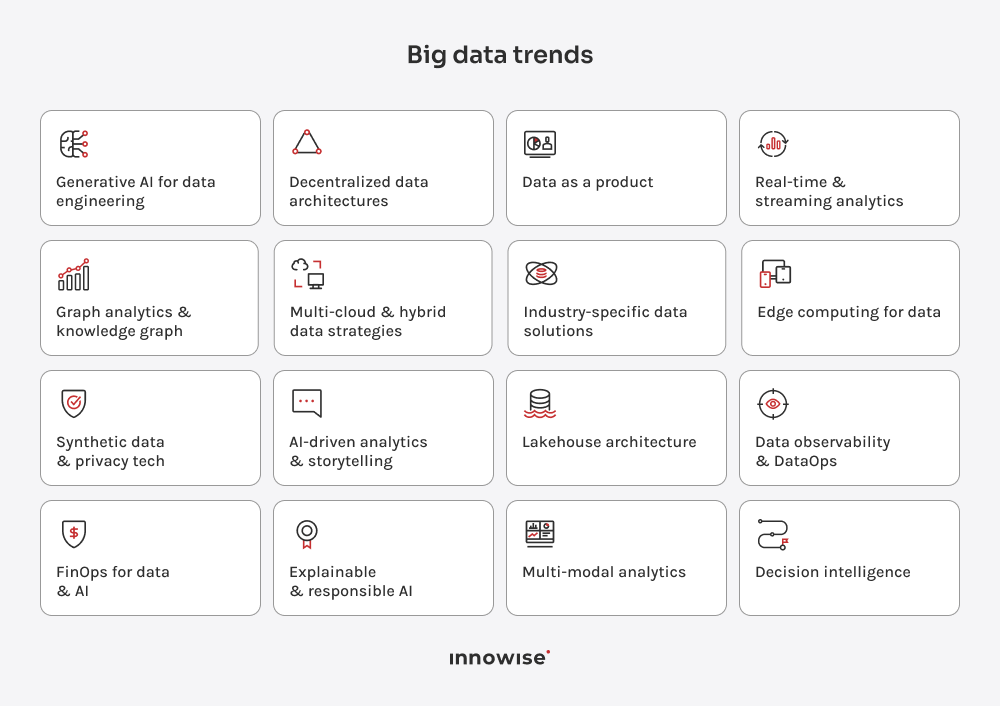

Laat ik beginnen met een gewaagde uitspraak: 2026 is het jaar van de waarheid data-industrie. We hebben het afgelopen decennium geëxperimenteerd met alle glimmende nieuwe technologieën onder de zon: AI, IoT, cloud platforms en al die modewoorden. Maar raad eens? Het is tijd om op te staan of je mist de boot. Als je bedrijf nog niet aan het uitzoeken is hoe je die enorme gegevensstroom kunt omzetten in iets bruikbaars, zul je in het stof verdwijnen.

2026 is het tijd om deze tools voor jou te laten werken en de trends voor te blijven. Benieuwd naar welke trends je moet kijken? Laten we er eens in duiken.

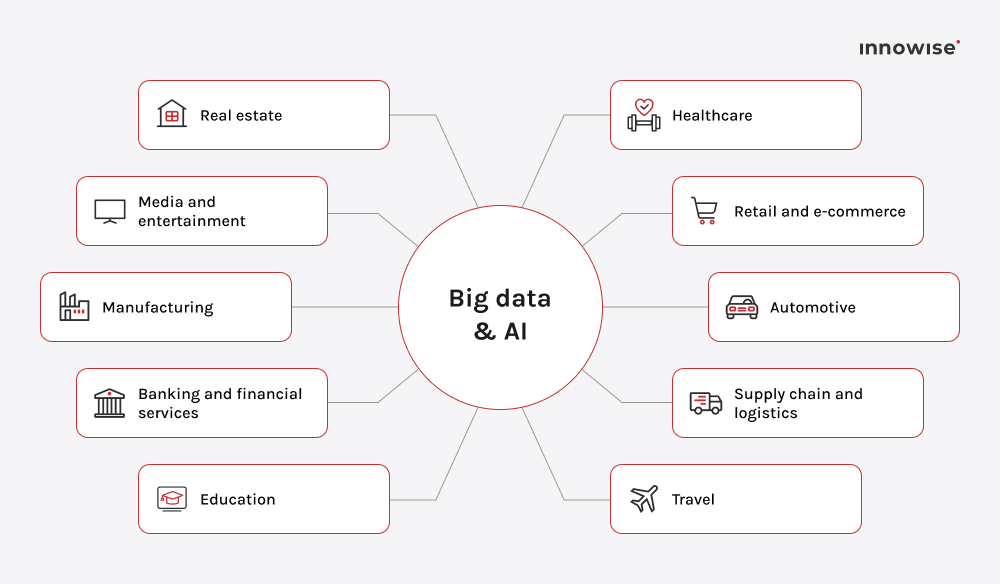

In 2026, Big Data wordt een belangrijke motor voor bedrijfswaarde en heeft invloed op elke industrie. Van AI-gestuurde analytics copilots tot real-time edge processing, deze trends definiëren de toekomst van big data die zich nu al ontvouwt. Ze zullen het succes van je bedrijf bepalen, dus lees dit stuk tot het einde.

Een van de meest impactvolle toekomstige trends in big data analytics is de opkomst van Generatieve AI. Hoewel het nog niet perfect is, pakt GenAI nu al de meest tijdrovende en vervelende onderdelen van data-engineering aan. AI zal de uitdagingen op het gebied van datakwaliteit niet helemaal wegnemen, maar het kan de uren die uw team besteedt aan datavoorbereiding wel aanzienlijk verminderen.

AI wordt nu ingebed in datapijplijnen en kan taken automatiseren zoals het opschonen van gegevens, het opvullen van ontbrekende gaten (imputatie) en het transformeren van gegevens. Dit betekent dat u schone, gebruiksklare gegevens hebt in een fractie van de tijd. Platformen zoals Databricks en Snowflake bevatten al ingebouwde functionaliteit voor generatieve pipelines die geschikt zijn voor AI. Het helpt organisaties bij het automatiseren van datatransformatie, het opvullen van hiaten en het leveren van datasets die klaar zijn voor AI.

Pro tip:

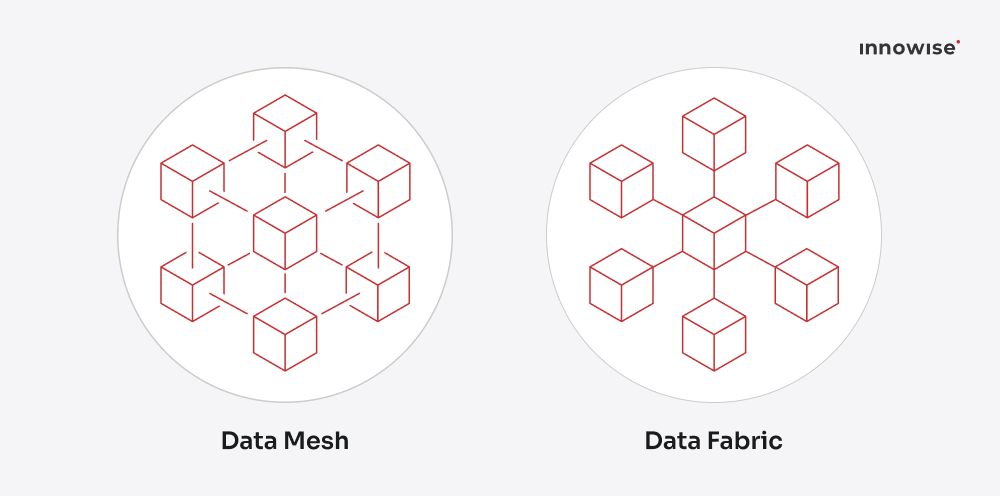

Vertrouwen op verouderde data-architecturen zal je tegenhouden. De sleutel om concurrerend te blijven is Data Mesh en Data Fabric.

Data Mesh decentraliseert het eigenaarschap van gegevens, waardoor domeinen hun eigen gegevens kunnen beheren en serveren, zonder de bottleneck van centrale IT. Data Fabric verbindt alle gegevensbronnen (cloud, on-prem, edge) tot een samenhangend systeem met geautomatiseerde metadata, lineage en integratie. Samen creëren ze een schaalbare, flexibele architectuur die flexibiliteit mogelijk maakt zonder dat dit ten koste gaat van de controle.

De groei van de Data Mesh-markt (naar verwachting $5,09 miljard tegen 2032) laat zien hoe snel bedrijven overstappen op gedecentraliseerde datamodellen.

Pro tip:

Terwijl Data Mesh de architectuur Voor decentralisatie werkt het het beste in combinatie met een “data-als-een-product”-mentaliteit, waarbij elke dataset eigendom is, gedocumenteerd en beheerd wordt als een echt product.

Data Mesh geeft je de structuur. Data als product geeft je discipline. In 2026, Slimme bedrijven decentraliseren gegevens niet alleen, ze beheren ze ook als een product, met een duidelijk eigenaarschap, documentatie en meetbare waarde. Hoewel veel bedrijven nog steeds werken aan het centraliseren van hun data, neemt de trend snel af van data die begraven liggen in willekeurige spreadsheets of geïsoleerde databases. In een data-als-een-product mentaliteit heeft elke dataset documentatie, rolverdeling, service-level agreements en een feedback-loop voor verbetering.

Op deze manier weet marketing waar zijn campagnegegevens zijn. Finance vertrouwt op de omzetcijfers zonder dat er een “gegevensafstemmingsdag” nodig is. En engineering hoeft niet langer de bottleneck te zijn tussen de dashboards van alle anderen.

Platformen zoals Snowflake Data Cloud en Databricks Marktplaats teams al helpen om dataproducten intern of met partners te publiceren, te delen en zelfs te gelde te maken. Dat opent nieuwe deuren voor samenwerking en nieuwe inkomstenstromen. Vooral wanneer je “dataproduct” iets wordt dat anderen willen kopen of waarop ze willen voortbouwen.

Pro tip:

"Bij Innowise zorgen we er altijd voor dat data voor je werkt op een manier die praktisch en efficiënt is. Onze aanpak integreert AI, automatiseert data workflows en maakt real-time inzichten mogelijk, zodat je team niet wordt belemmerd door complexiteit. Je krijgt schone, bruikbare data wanneer je die nodig hebt, zodat je beslissingen kunt nemen op basis van feiten."

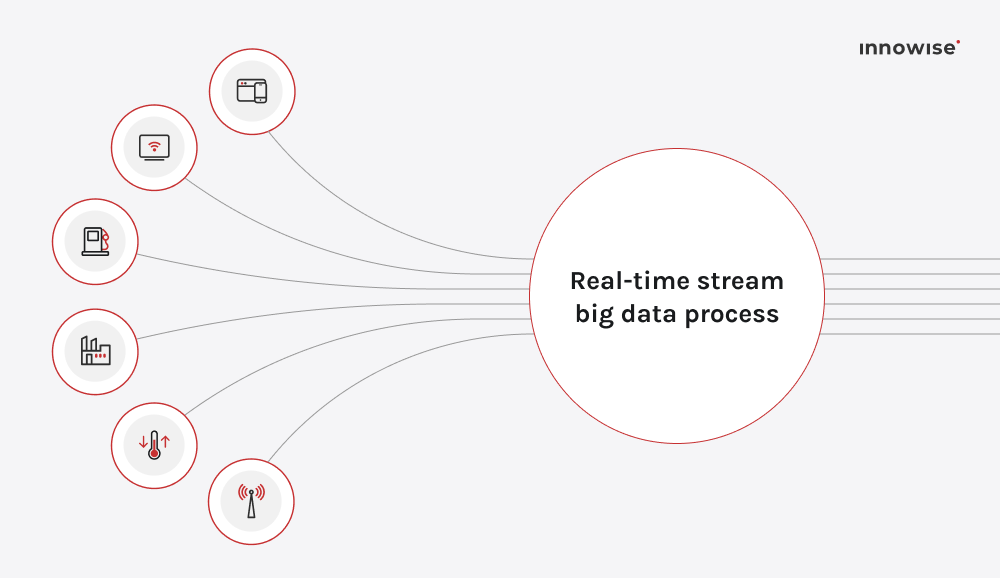

De volgende op de lijst van toekomstige trends in big data is real-time analyse. Hoewel het concept al jaren in ontwikkeling is, zal het zich tegen 2026 snel ontwikkelen van een concurrentievoordeel tot een belangrijk instrument. kernbehoefte voor organisaties die direct inzicht nodig hebben. Wanneer u gegevens verwerkt op het moment dat ze binnenkomen, in plaats van te wachten op batches, kunt u reageren op gebeurtenissen, signalen en patronen. zoals ze gebeuren. Voor de big data-arena betekent dit het streamen van gegevensbronnen met grote volumes (IoT-sensoren, gebruikersinteracties, logbestanden) via pijplijnen die binnen seconden of milliseconden analyseren en reageren.

De markt ondersteunt deze verschuiving. De wereldwijde streaming analytics-sector werd gewaardeerd op $23,4 miljard in 2023 en zal naar verwachting groeien tot ongeveer $ 128,4 miljard in 2030, met een CAGR van ongeveer 28,3% tussen 2024 en 2030. Industrieën zoals financiën, telecom, productie en detailhandel maken al gebruik van stream-based modellen voor fraudedetectie, dynamische prijsbepaling, voorspellend onderhoud en optimalisatie van klantervaringen.

Pro tip:

Als uw datastrategie real-time nog steeds als een “extraatje” beschouwt en zich eerst sterk richt op batch, 2026 zal de kloof benadrukken, geloof me.

Graph analytics staat in 2026 in de schijnwerpers, niet als een nieuwe technologie, maar omdat de toepassing ervan snel wordt versneld door AI-integratie. In plaats van gegevens uitsluitend te behandelen als rijen en kolommen, gebruiken organisaties grafieken om te begrijpen hoe entiteiten met elkaar verbonden zijn: klanten, producten, sensorknooppunten, fraudecircuits, noem maar op. Kennisgrafieken en grafiekdatabases maken dit mogelijk: ze brengen complexe relaties in kaart en leggen inzichten bloot die traditionele methoden maar moeilijk aan het licht kunnen brengen. Een In een recent grafieken database rapport van Verified Market Reports wordt het volgende uitgelegd dat grafiekdatabases nu cruciaal zijn voor real-time verwerking, semantische relaties en AI-gestuurde anomaliedetectie.

Voor bedrijfsleiders is het belangrijkste voordeel het volgende: je ontdekt waarom dingen gebeuren, niet alleen dat ze gebeuren. Bij fraudedetectie spot je het netwerk van actoren; bij aanbevelingen breng je verborgen affiniteiten in kaart; bij IoT traceer je storingsketens. Die kracht brengt dieper inzicht, snellere detectie, en meer strategische actie.

Pro tip:

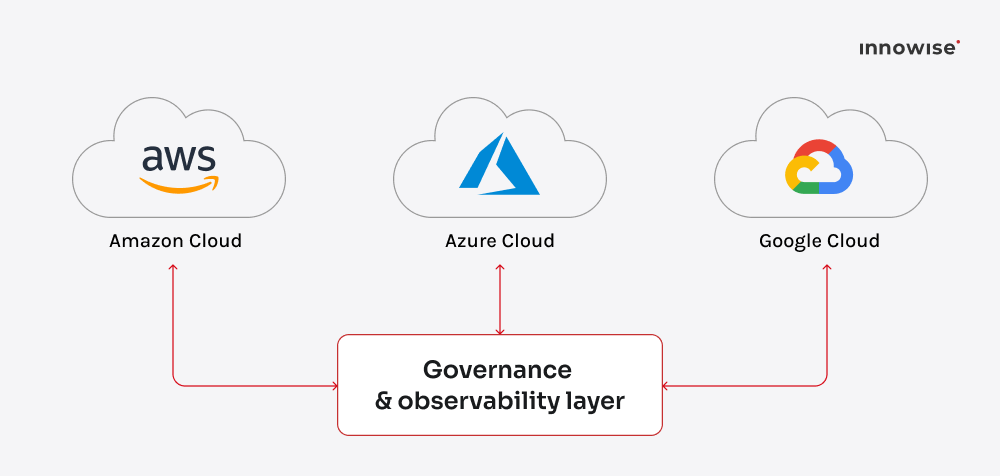

In 2026 wordt alleen vertrouwen op één cloudprovider steeds meer gezien als een risico, net als al je investeringen in één aandeel stoppen. Hoewel veel organisaties nog steeds hoofdzakelijk één platform gebruiken, spelen de strategisch meest geavanceerde bedrijven nu het spel met meerdere clouds. Ze balanceren diensten van AWS, Azure en Google Cloud om lock-in te voorkomen en de beste prestatie-kostenverhouding uit elk van hen te halen.

Hybride opstellingen zijn ook in opkomst. Hierbij combineren organisaties cloudservices met hun bestaande datacenters op locatie. De redenen voor deze hybride aanpak gaan verder dan alleen het lokaal houden van gevoelige gegevens:

Het addertje onder het gras? Complexiteit. Het verspreiden van workloads over clouds brengt meer bewegende delen met zich mee: verschillende API's, factureringssystemen en governanceregels. De winnaars zijn degenen die de orkestratie- en monitoringslaag automatiseren. Denk aan cross-cloud query engines, verenigd identiteitsbeheer en observatietools die latency en kosten in realtime bijhouden.

Pro tip:

Generieke dataplatforms zijn geweldig. Totdat ze niets bijzonders beginnen op te lossen. Dit is waarom, in 2026, Bedrijven in superconcurrerende, risicovolle of gereguleerde sectoren zijn klaar met generieke tools. Ze willen op hun branche afgestemde oplossingen die hun taal spreken, met hun regelgeving omgaan en resultaten leveren in plaats van dashboards die er indrukwekkend uitzien maar weinig betekenen.

Waarom vragen bedrijven dan plotseling om deze gespecialiseerde oplossingen in 2026? Het komt eigenlijk neer op drie grote dingen:

Teams in de gezondheidszorg willen voorspellende analyses die artsen helpen risico's voor patiënten te herkennen voordat ze escaleren. Banken geven om fraudedetectie, Risicoscores en hypergepersonaliseerde aanbiedingen. Fabrikanten volgen de gezondheid van apparatuur en de zichtbaarheid van de toeleveringsketen tot op de minuut. En retailers combineren transactiegegevens met sensoren in de winkel en sociale trends om de vraag te voorspellen zonder in spreadsheets te hoeven staren.

Daarom verschuift de markt naar domeinspecifieke gegevensproducten: kant-en-klare modellen, connectoren en compliance frameworks die rechtstreeks in echte workflows passen. Deze specialisatie laat al een enorme groei zien in verticale markten. Bijvoorbeeld, volgens Visiongain, de markt voor gezondheidszorganalytics alleen zal $101 miljard bereiken tegen 2031, gedreven door dit soort specialisatie.

Pro tip:

In 2026, is de vraag naar onmiddellijke, geautomatiseerde actie van het grootste belang. Hoewel de cloud nog steeds van vitaal belang is, realiseren bedrijven zich dat het te veel tijd en geld kost om de cloud te sturen. elke byte van gegevens naar een server op afstand voor verwerking.

Edge computing is de oplossing. Het brengt gegevensverwerking dichter bij de plaats waar ze wordt gegenereerd: sensoren, machines, apparaten, zelfs auto's. In plaats van terabytes over het netwerk te sturen, verwerk je de belangrijke gegevens lokaal en handel je onmiddellijk.

Waarom deze trend explodeert nu?

Dit is vooral belangrijk voor industrieën waar snelheid van levensbelang is: slimme fabrieken die productielijnen direct aanpassen, ziekenhuizen die patiënten in realtime monitoren of winkelketens die hun prijzen dynamisch beheren op basis van de lokale vraag. En er is geld voor: IDC voorspellingen dat de wereldwijde uitgaven aan edge computing-oplossingen zullen groeien met een CAGR van ~13,8% en zullen uitkomen op bijna $380 miljard tegen 2028.

De slimste organisaties vervangen de cloud niet, ze vullen hem aan. Ze gebruiken een hybride opzet: lokale verwerking voor snelheid, cloudopslag voor schaalbaarheid. Het resultaat is prachtig: lagere latentie, lagere bandbreedtekosten en snellere beslissingen die echt iets opleveren.

Pro tip:

In 2026, Toegang tot echte gegevens is lastiger dan ooit: privacywetten zijn strenger, toezichthouders zijn waakzaam en gebruikers zijn veel minder vergevingsgezind. Daarom hebben we synthetische gegevens.

De trend explodeert nu omdat de GenAI giek heeft synthetische data eindelijk van voldoende hoge kwaliteit gemaakt om complexe informatie uit de echte wereld betrouwbaar na te bootsen. Bedrijven vertrouwen steeds vaker op deze kunstmatige, statistisch nauwkeurige gegevens om massieve AI modellen sneller en goedkoper te trainen dan met traditionele methoden, terwijl ze automatisch voldoen aan strenge compliance-eisen zoals GDPR en de AI Act van de EU.

Tools voor synthetische gegevens zijn overal: van financiële bedrijven die modellen voor fraudedetectie trainen tot bedrijven in de gezondheidszorg die AI diagnoses uitvoeren zonder patiëntgegevens bloot te geven. Gartner verwacht dat tegen 2030, synthetische gegevens overtreffen echte gegevens in AI-training, omdat het veiliger, sneller en gemakkelijker schaalbaar is.

Pro tip:

In 2026, analytics voelt eindelijk menselijk. AI copilots en narratieve visualisatietools zetten gegevens nu om in heldere verhalen in plaats van eindeloze grafieken. Tools zoals Power BI Copilot, Tableau GPT, kameelAI, en de GenAI-laag van Looker kan query's uitvoeren, inzichten samenvatten en in gewone taal uitleggen.

Zie ze als uw gegevensanalist. Je kunt vragen: “Hoe heeft de omzet zich dit kwartaal ontwikkeld?” of “Welke campagne heeft de hoogste ROI opgeleverd?” en direct antwoorden krijgen in duidelijke taal. Tools zoals Power BI Copiloot, Tableau GPT, en kameelAI doen dit al, door grote taalmodellen rechtstreeks te verbinden met de gegevens van uw bedrijf.

Pro tip:

In 2026, De grens tussen data lakes en warehouses is vervaagd. De nieuwe standaard is Lakehouse-architectuur, Dit is een hybride model dat de schaalbaarheid van data lakes combineert met de structuur en prestaties van warehouses. Je kunt ongestructureerde gegevens opslaan, deze met SQL opvragen en machine learning workloads uitvoeren. Allemaal op één plek. Zonder te jongleren met tien verschillende platformen.

Verkopers zoals Databricks, Snowflake, en Google BigQuery leiden hier de leiding.

Pro tip:

In 2026, Het beheren van datapijplijnen zonder waarneembaarheid is als vliegen met het dashboard uitgeschakeld. Je beweegt misschien snel, maar je hebt geen idee wat er kapot gaat. Waarneembaarheid van gegevens is hoe teams inzicht krijgen in de gezondheid, versheid en betrouwbaarheid van hun gegevens. Het vertelt je wanneer er iets mis is, waarom het is gebeurd en hoe je het kunt oplossen voordat de dashboards onzin beginnen te vertellen.

Waarom is dit essentieel? nu? Omdat je geen governance of compliance kunt hebben zonder.

Dit gaat hand in hand met DataOps, waarmee zaken als testen en implementeren worden geautomatiseerd. Samen zorgen observability en DataOps voor een betrouwbare, compliant en rotsvaste gegevensbackbone met minder verrassingen en snellere hersteltijden.

Pro tip:

Hebben cloudrekeningen u wel eens 's nachts wakker gehouden? Nu datavolumes exploderen en AI werklasten zich vermenigvuldigen, FinOps (financiële operaties voor cloud en data) wordt essentieel. Het doel is eenvoudig: begrijp waar elke dollar in uw data-ecosysteem naartoe gaat en zorg ervoor dat u er daadwerkelijk bedrijfswaarde mee koopt en niet alleen grotere servers.

Het trainen van grote modellen, het opslaan van petabytes aan gegevens en het uitvoeren van eindeloze query's kan snel budgetten leegmaken. FinOps-teams gebruiken nu analyse en automatisering om kosten in realtime volgen, Inefficiënties op te sporen en het gebruik tussen afdelingen te voorspellen. Cloud leveranciers bieden hier zelfs native tools voor (AWS Cost Explorer, Google Cloud Billing, Azure Cost Management), maar de echte winst zit in het direct integreren van financiële meetgegevens in je data workflows.

Pro tip:

In 2026, AI regelt zo veel van het bedrijfsleven dat “vertrouw gewoon op het model” niet meer opgaat. Raden van bestuur, toezichthouders en klanten verwachten allemaal transparantie. Ze willen weten waarom een algoritme een beslissing nam, niet alleen het resultaat. Daarom Uitlegbare AI (XAI) en Verantwoordelijk AI worden steeds populairder. Samen maken ze machine learning minder een zwarte doos en meer een systeem dat je kunt besturen.

Banken gebruiken al verklaarbare modellen om kredietbeslissingen te rechtvaardigen tegenover auditors. Zorgverleners vertrouwen op hen om te laten zien hoe diagnostische algoritmen tot conclusies komen. Zelfs HR-systemen worden onder de loep genomen om aan te tonen dat aanbevelingen voor aanname eerlijk zijn. Wanneer beslissingen mensen of winst beïnvloeden, is blind vertrouwen in AI geen strategie; het is een risico.

Pro tip:

Tegen 2026, ontwikkeling van big data tabellen en dashboards naar een nieuw tijdperk van multimodale analyses. Hier worden tekst, afbeeldingen, video en sensorgegevens gecombineerd om een compleet, contextrijk beeld te creëren. In plaats van feedback van klanten en verkoopcijfers afzonderlijk te analyseren, kunnen teams nu gesprekstranscripties, productfoto's en gebruikersgedrag met elkaar in verband brengen in één enkele werkruimte.

Klinkt als sciencefiction, toch? Maar platforms zoals Databricks MozaïekML, Antropische Claude voor gegevens, en OpenAI's GPT-4 Turbo met visie al omgaan met invoer van gegevens in meerdere formaten. Het resultaat is cool. Contextrijke inzichten voelen bijna intuïtief aan. Stel je voor dat je storingen aan apparatuur kunt voorspellen door het analyseren van trillingslogs, warmtebeelden en onderhoudsnotities. Dat is wat multimodale analyse mogelijk maakt.

Pro tip:

En de laatste op de lijst van belangrijkste trends in big data is Decision Intelligence (DI). Het mengt gegevenswetenschap, psychologie en bedrijfslogica om organisaties te helpen sneller slimmere beslissingen te nemen. In plaats van honderd statistieken naar je toe te gooien, modelleren DI systemen hoe keuzes leiden tot uitkomsten en simuleren vervolgens scenario's voordat je een beslissing neemt.

Zie het als analytics die antwoord geeft op “Wat gebeurt er als we dit echt doen?”, niet alleen “Wat is er vorig kwartaal gebeurd?” Retailers gebruiken het om prijsstrategieën te testen voordat ze met de introductie beginnen. Banken gebruiken het om risicoblootstelling over portefeuilles te simuleren. Zelfs HR-teams gebruiken DI om de gevolgen van aanname en retentie te voorspellen voordat het beleid live gaat.

De markt laat deze verschuiving zien: de wereldwijde decision intelligence-markt werd geschat op $15,22 miljard in 2024. en zal naar verwachting $36,34 miljard tegen 2030, en groeit met ongeveer 15,4% CAGR.

Pro tip:

Wat is de toekomst van big data? 2026 brengt een nieuw niveau van volwassenheid. De focus ligt nu op het kiezen van de tools en methoden die daadwerkelijk impact creëren. Bedrijven die technologie koppelen aan duidelijke doelen zullen snellere groei en sterkere resultaten zien.

Gebruik AI waar het tijd bespaart en nauwkeurigheid verbetert. Bouw een data mesh die teams helpt samen te werken in plaats van in silo's. Investeer in realtime analyses die u helpen op het juiste moment te handelen, niet achteraf.

De leiders van dit jaar begrijpen één ding: waarde ontstaat door gegevens doelgericht toe te passen. Kies wat bij je strategie past, laat het samenwerken tussen teams en laat data de motor worden achter elke slimme zet die je doet.

Hoofd Big Data en AI

Philip brengt scherpe focus aan in alles wat met data en AI te maken heeft. Hij is degene die in een vroeg stadium de juiste vragen stelt, een sterke technische visie bepaalt en ervoor zorgt dat we niet alleen slimme systemen bouwen, maar ook de juiste, voor echte bedrijfswaarde.

Uw bericht is verzonden.

We verwerken je aanvraag en nemen zo snel mogelijk contact met je op.

Door u aan te melden gaat u akkoord met onze Privacybeleidmet inbegrip van het gebruik van cookies en de overdracht van uw persoonlijke gegevens.