Su mensaje ha sido enviado.

Procesaremos su solicitud y nos pondremos en contacto con usted lo antes posible.

El formulario se ha enviado correctamente.

Encontrará más información en su buzón.

Seleccionar idioma

Permítanme empezar con una afirmación audaz: 2026 es el año del ajuste de cuentas para los grandes industria de datos. Hemos pasado la última década experimentando con todas las nuevas tecnologías brillantes bajo el sol: IA, IoT, plataformas en la nube y todas esas palabras de moda. Pero, ¿adivina qué? Es hora de ponerse en pie o perderás el barco. Si su empresa aún no ha encontrado la manera de convertir esa avalancha masiva de datos en algo útil, se va a quedar en la cuneta.

2026 es el momento de poner estas herramientas a su servicio y adelantarse a los acontecimientos. ¿Siente curiosidad por saber qué tendencias seguir? Sumerjámonos en ellas.

En 2026, En los próximos años, los macrodatos se convertirán en un motor clave del valor empresarial y afectarán a todos los sectores. Desde los copilotos analíticos impulsados por IA hasta el procesamiento edge en tiempo real, estas tendencias definen la futuro de los macrodatos que ya se está desarrollando. Darán forma a su éxito empresarial, así que lea este artículo hasta el final.

Uno de los más impactantes tendencias futuras en el análisis de big data es el auge de Generative IA. Aunque todavía no es perfecto, GenAI ya está abordando las partes más tediosas y que más tiempo consumen de la ingeniería de datos. IA no eliminará por completo los problemas de calidad de datos, pero puede reducir significativamente las horas que su equipo dedica a la preparación de datos.

IA se está integrando ahora en pipelines de datos, capaces de automatizar tareas como la limpieza de datos, el relleno de lagunas (imputación) y la transformación de datos. Esto significa que dispondrá de datos limpios y listos para su uso en una fracción del tiempo. Por ejemplo, plataformas como Databricks y Snowflake ya incluyen funciones integradas para pipelines de datos generativas habilitadas para IA. Ayuda a las organizaciones a automatizar la transformación de datos, el relleno de lagunas y la entrega de conjuntos de datos listos para IA.

Consejo profesional:

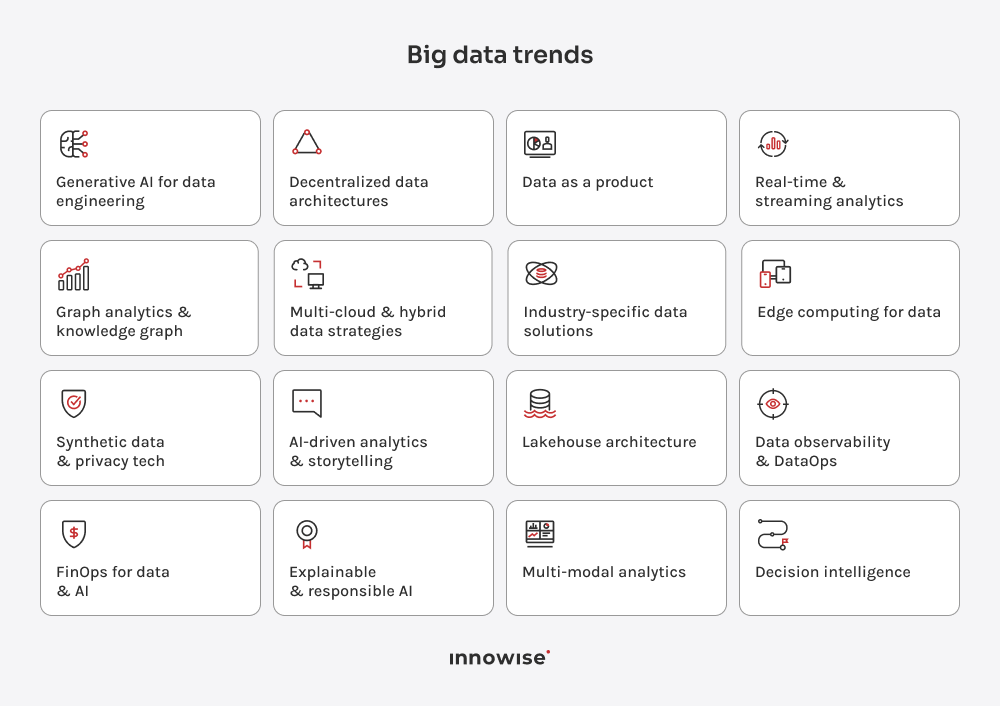

Confiar en arquitecturas de datos obsoletas le frenará. La clave para seguir siendo competitivo es adoptar Data Mesh y Data Fabric.

Data Mesh descentraliza la propiedad de los datos, permitiendo a los equipos de dominio gestionar y servir sus propios datos, eliminando el cuello de botella de la IT central. Data Fabric conecta todas las fuentes de datos (en la nube, on-prem, edge) en un sistema cohesivo con metadatos automatizados, linaje e integración. Juntos, crean una arquitectura escalable y flexible que permite agilidad sin sacrificar el control.

Crecimiento del mercado de malla de datos (proyectada para alcanzar $5.090 millones en 2032) muestra la rapidez con que las empresas están cambiando hacia modelos de datos descentralizados.

Consejo profesional:

Mientras que Data Mesh define el arquitectura para la descentralización, funciona mejor cuando se combina con una mentalidad de “los datos como un producto”, en la que cada conjunto de datos se posee, documenta y gestiona como un producto real.

La malla de datos te da la estructura. Los datos como producto aportan disciplina. En 2026, Las empresas inteligentes no sólo descentralizan los datos, sino que los gestionan como un producto, con una propiedad clara, documentación y un valor medible. Aunque muchas empresas siguen trabajando para centralizar sus datos, la tendencia se aleja rápidamente de los datos enterrados en hojas de cálculo aleatorias o bases de datos aisladas. En una mentalidad de datos como producto, cada conjunto de datos tiene documentación, asignación de funciones, acuerdos de nivel de servicio y un circuito de retroalimentación para la mejora.

De este modo, marketing sabe dónde están los datos de sus campañas. Finanzas confía en las cifras de ingresos sin necesidad de un “día de reconciliación de datos”. Y el departamento de ingeniería por fin deja de actuar como el cuello de botella entre los cuadros de mando de todos los demás.

Plataformas como Snowflake Data Cloud y Mercado Databricks ya ayudan a los equipos a publicar, compartir e incluso monetizar productos de datos internamente o con socios. Esto abre nuevas puertas a la colaboración y a nuevas fuentes de ingresos. Sobre todo cuando tu “producto de datos” se convierte en algo que otros quieren comprar o desarrollar.

Consejo profesional:

"En Innowise, siempre nos aseguramos de que los datos trabajen para usted de una manera práctica y eficiente. Nuestro enfoque integra IA, automatiza los flujos de trabajo de datos y permite obtener información en tiempo real, para que su equipo no se vea abrumado por la complejidad. Obtendrá datos claros y procesables cuando los necesite, para que pueda tomar decisiones basadas en hechos.."

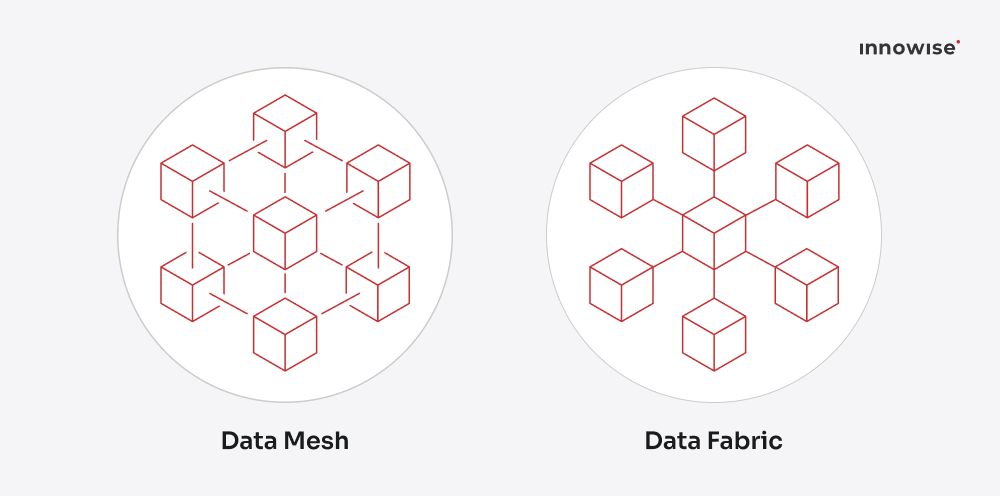

El siguiente en la lista de tendencias futuras en big data es análisis en tiempo real. Aunque el concepto lleva años desarrollándose, en 2026 habrá pasado rápidamente de ser una ventaja competitiva a una necesidad básica para organizaciones que exigen información instantánea. Cuando se procesan los datos en el momento en que llegan, en lugar de esperar a los lotes, se desbloquea la capacidad de actuar sobre eventos, señales y patrones. a medida que suceden. En el ámbito de los macrodatos, esto significa streaming de fuentes de datos de gran volumen (sensores IoT, interacciones de usuarios, registros) a través de pipelines que analizan y responden en cuestión de segundos o milisegundos.

El mercado respalda este cambio. El sector mundial de análisis de streaming se valoró en $23.400 millones en 2023 y se prevé que crezca hasta aproximadamente $ 128.400 millones en 2030, con una CAGR de aproximadamente 28,3% entre 2024 y 2030. Sectores como las finanzas, las telecomunicaciones, la fabricación y el comercio minorista ya utilizan modelos basados en flujos para la detección de fraudes, la fijación dinámica de precios, el mantenimiento predictivo y la optimización de la experiencia del cliente.

Consejo profesional:

Si su estrategia de datos todavía trata el tiempo real como un “extra” y se centra en gran medida en el lote primero, 2026 resaltará la brecha, créeme.

El análisis de gráficos se convierte en el centro de atención en 2026, no como una nueva tecnología, sino porque su adopción se está acelerando rápidamente gracias a la integración IA. En lugar de tratar los datos únicamente como filas y columnas, las organizaciones utilizan gráficos para comprender cómo se conectan las entidades: clientes, productos, nodos de sensores, círculos de fraude, lo que sea. Gráficos de conocimiento y bases de datos gráficas lo hacen posible: trazan relaciones complejas y sacan a la luz datos que los métodos tradicionales no consiguen revelar. Por ejemplo, un El reciente informe sobre bases de datos gráficas de Verified Market Reports explica que las bases de datos de grafos son ahora fundamentales para el procesamiento en tiempo real, las relaciones semánticas y la detección de anomalías IA.

Para los empresarios, la principal ventaja es que descubren por qué suceden cosas, no sólo que ocurren. En la detección del fraude, se detecta la red de actores; en la recomendación, se cartografían las afinidades ocultas; en el IoT, se rastrean las cadenas de fallos. Ese poder aporta visión más profunda, detección más rápida, y una acción más estratégica.

Consejo profesional:

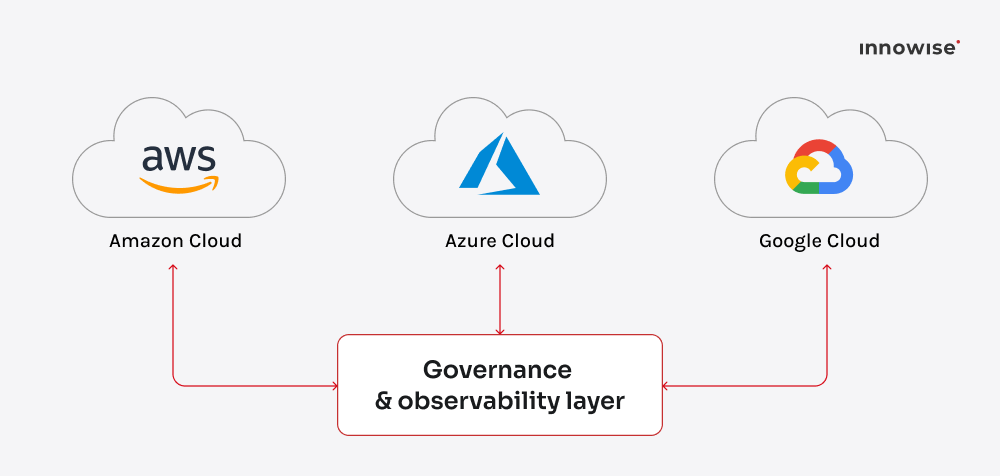

En 2026, depender exclusivamente de un único proveedor de nube se considera cada vez más un riesgo, como poner toda la inversión en una sola acción. Aunque muchas organizaciones siguen utilizando principalmente una plataforma, las empresas más avanzadas estratégicamente juegan ahora a la multi-nube. Equilibran los servicios de AWS, Azure y Google Cloud para evitar el bloqueo y exprimir la mejor relación rendimiento-coste de cada una de ellas.

Las configuraciones híbridas también están aumentando. Aquí es donde las organizaciones combinan servicios en la nube con sus centros de datos locales. Las razones para este enfoque híbrido van más allá de mantener los datos confidenciales en las instalaciones:

¿El truco? La complejidad. Repartir las cargas de trabajo entre nubes introduce más partes móviles: diferentes API, sistemas de facturación y normas de gobernanza. Los ganadores son los que automatizan la capa de orquestación y supervisión. Piense en motores de consulta entre nubes, gestión unificada de identidades y herramientas de observabilidad que rastreen la latencia y el coste en tiempo real.

Consejo profesional:

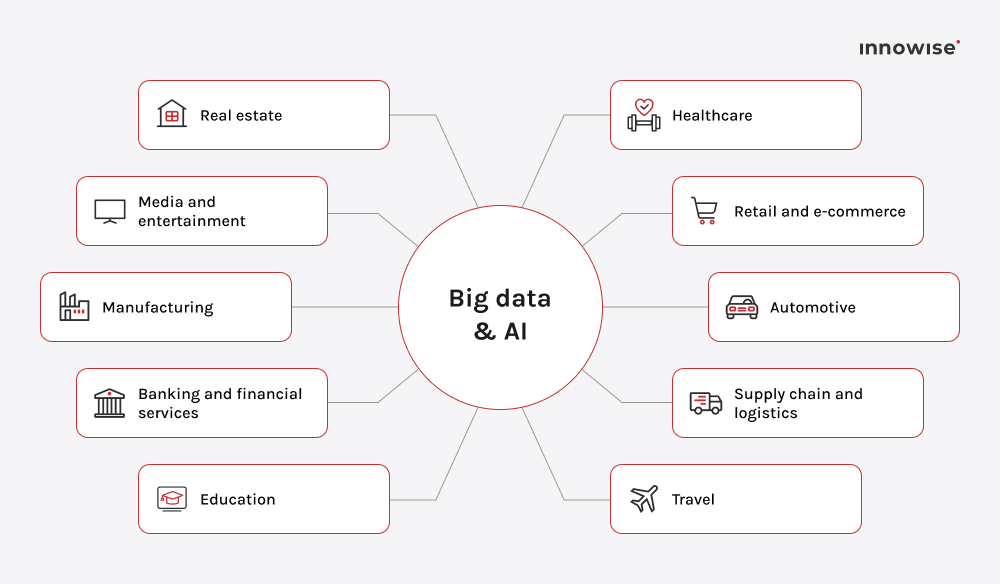

Las plataformas genéricas de datos son geniales. Hasta que empiezan a no resolver nada en particular. Por eso, en 2026, Las empresas de sectores muy competitivos, de alto riesgo o regulados ya no utilizan herramientas genéricas. Quieren soluciones adaptadas a su sector que hablen su idioma, cumplan sus normativas y ofrezcan resultados, en lugar de cuadros de mando que impresionan pero significan poco.

Entonces, ¿por qué las empresas demandan de repente estas soluciones especializadas en 2026? En realidad se reduce a tres grandes cosas:

Los equipos sanitarios quieren análisis predictivos que ayudan a los médicos a detectar los riesgos de los pacientes antes de que se agraven. Los bancos se preocupan por la detección del fraude, y ofertas hiperpersonalizadas. Los fabricantes controlan al minuto el estado de los equipos y la visibilidad de la cadena de suministro. Y los minoristas mezclan datos de transacciones con sensores en las tiendas y tendencias sociales para prever la demanda sin tener que mirar hojas de cálculo.

Por eso el mercado se está decantando por productos de datos específicos del sector: modelos prediseñados, conectores y marcos de cumplimiento que se adaptan directamente a los flujos de trabajo reales. Esta especialización ya está demostrando un crecimiento masivo en los mercados verticales. Por ejemplo, según Visiongain, el mercado de la analítica sanitaria alcanzará $101 mil millones para 2031, impulsada por este tipo de especialización.

Consejo profesional:

En 2026, la demanda de acciones inmediatas y automatizadas es primordial. Aunque la nube sigue siendo vital, las empresas se están dando cuenta de que cuesta demasiado tiempo y dinero enviar... cada byte de datos a un servidor distante para su procesamiento.

Edge computing es la solución. Acerca el procesamiento de datos al lugar donde se generan: sensores, máquinas, dispositivos, incluso coches. En lugar de enviar terabytes a través de la red, se procesan los datos importantes localmente y se actúa al instante.

¿Por qué se dispara esta tendencia? ahora?

Esto es muy importante para las industrias en las que la velocidad es la vida: fábricas inteligentes que ajustan las líneas de producción sobre la marcha, hospitales que controlan a los pacientes en tiempo real o cadenas minoristas que gestionan los precios de forma dinámica en función de la demanda local. Y el dinero lo respalda: Previsiones de IDC El gasto mundial en soluciones de computación periférica crecerá a una tasa compuesta anual de ~13,8% y alcanzará casi los 2.000 millones de euros. $380.000 millones en 2028.

Las organizaciones más inteligentes no están sustituyendo a la nube, sino completándola. Utilizan una configuración híbrida: procesamiento local para la velocidad, almacenamiento en la nube para la escala. El resultado es magnífico: menor latencia, menos costes de ancho de banda y decisiones más rápidas que realmente mueven la aguja.

Consejo profesional:

En 2026, El acceso a los datos del mundo real es más complicado que nunca: las leyes de privacidad son más estrictas, los reguladores están vigilantes y los usuarios son mucho menos indulgentes. Por eso necesitamos datos sintéticos.

La tendencia se dispara ahora porque el Pluma GenAI ha conseguido por fin que los datos sintéticos tengan la calidad suficiente para imitar de forma fiable la información compleja del mundo real. Las empresas confían cada vez más en estos datos artificiales y estadísticamente precisos para entrenar modelos IA masivos de forma más rápida y barata que con los métodos tradicionales, al tiempo que satisfacen automáticamente requisitos de cumplimiento estrictos como el GDPR y la Ley IA de la UE.

Las herramientas de datos sintéticos están en todas partes: desde empresas financieras que entrenan modelos de detección de fraudes hasta compañías sanitarias que realizan diagnósticos AI sin exponer los datos de los pacientes. Gartner espera que para 2030, los datos sintéticos superarán a los reales en la formación IA, porque es más seguro, más rápido y más fácil de ampliar.

Consejo profesional:

En 2026, La analítica por fin se siente humana. Los copilotos IA y las herramientas de visualización narrativa ahora convierten los datos en historias claras en lugar de interminables gráficos. Herramientas como Power BI Copilot, Tableau GPT, camelloAI, y la capa GenAI de Looker puede consultar, resumir y explicar la información en un lenguaje sencillo.

Piense en ellos como si fueran sus analistas de datos. Puede preguntar: “¿Cómo han evolucionado los ingresos este trimestre?” o “¿Qué campaña ha generado el mayor ROI?” y obtener respuestas instantáneas en un lenguaje sencillo. Herramientas como Power BI Copiloto, Tableau GPT, y camelloAI ya lo hacen, conectando grandes modelos lingüísticos directamente a los datos de su empresa.

Consejo profesional:

En 2026, la línea que separa los lagos de datos de los almacenes se ha difuminado. La nueva norma es lakehouse architecture, que es un modelo híbrido que combina la escalabilidad de los lagos de datos con la estructura y el rendimiento de los almacenes. Puede almacenar datos no estructurados, consultarlos con SQL y ejecutar cargas de trabajo de aprendizaje automático. Todo en el mismo sitio. Sin tener que hacer malabarismos con diez plataformas diferentes.

Vendedores como Databricks, Snowflake, y Google BigQuery están a la cabeza.

Consejo profesional:

En 2026, Gestionar pipelines de datos sin observabilidad es como pilotar un avión con el cuadro de mandos apagado. Puede que te muevas rápido, pero no tienes ni idea de lo que se está rompiendo. La observabilidad de los datos es la forma en que los equipos obtienen visibilidad de la salud, frescura y fiabilidad de sus datos. Te dice cuándo algo va mal, por qué ha ocurrido y cómo solucionarlo antes de que los cuadros de mando empiecen a mostrar tonterías.

¿Por qué es esencial ahora? Porque no puede haber gobernanza ni cumplimiento sin ella.

Esto va de la mano con DataOps, que automatiza aspectos como las pruebas y la implantación. Juntos, la observabilidad y DataOps le proporcionan una columna vertebral de datos fiable, conforme y sólida como una roca, con menos sorpresas y tiempos de recuperación más rápidos.

Consejo profesional:

¿Alguna vez le han quitado el sueño las facturas de la nube? A medida que los volúmenes de datos explotan y las cargas de trabajo IA se multiplican, FinOps (operaciones financieras para la nube y los datos) se convierte en esencial. El objetivo es sencillo: entender a dónde va cada dólar de su ecosistema de datos y asegurarse de que realmente está comprando valor empresarial, no solo servidores más grandes.

La formación de grandes modelos, el almacenamiento de petabytes de datos y la ejecución de interminables consultas pueden agotar rápidamente los presupuestos. Los equipos de FinOps utilizan ahora la analítica y la automatización para seguimiento de los costes en tiempo real, y prever el uso en todos los departamentos. Los proveedores de Cloud ofrecen incluso herramientas nativas para ello (AWS Cost Explorer, Google Cloud Billing, Azure Cost Management), pero las verdaderas ventajas provienen de la integración de métricas financieras directamente en sus flujos de trabajo de datos.

Consejo profesional:

En 2026, El IA dirige una parte tan importante de los negocios que ya no vale eso de “confía en el modelo”. Los consejos de administración, los reguladores y los clientes esperan transparencia. Quieren saber por qué un algoritmo tomó una decisión, no sólo el resultado. Por eso Explicable IA (XAI) y Responsable IA están ganando terreno. Juntos, hacen que el aprendizaje automático sea menos una caja negra y más un sistema que se puede gobernar.

Los bancos ya utilizan modelos explicables para justificar las decisiones crediticias ante los auditores. Los profesionales sanitarios confían en ellos para mostrar cómo llegan a sus conclusiones los algoritmos de diagnóstico. Incluso los sistemas de RRHH están sometidos a escrutinio para demostrar la imparcialidad de las recomendaciones de contratación. Cuando las decisiones afectan a las personas o a los beneficios, la fe ciega en IA no es estrategia; es un riesgo.

Consejo profesional:

En 2026, desarrollo de macrodatos irá más allá de las tablas y los cuadros de mando para adentrarse en una nueva era de análisis multimodal. Aquí, los datos de texto, imágenes, vídeo y sensores se combinan para crear una imagen completa y rica en contexto. En lugar de analizar las opiniones de los clientes y las cifras de ventas por separado, los equipos pueden ahora correlacionar transcripciones de llamadas, fotos de productos y comportamiento de los usuarios en un único espacio de trabajo.

Suena a ciencia ficción, ¿verdad? Pero plataformas como MosaicML de Databricks, Reclamo antrópico de datos, y GPT-4 Turbo de OpenIA con visión ya manejan entradas de datos multiformato. El resultado es genial. La información contextual es casi intuitiva. Imagine predecir fallos en los equipos mediante el análisis cruzado de registros de vibraciones, imágenes térmicas y notas de mantenimiento. Eso es lo que permite el análisis multimodal.

Consejo profesional:

Y el último de la lista de tendencias clave en big data es inteligencia de decisión (DI). En combina la ciencia de datos, Los sistemas de DI se basan en el conocimiento, la psicología y la lógica empresarial para ayudar a las organizaciones a tomar decisiones más inteligentes con mayor rapidez. En lugar de arrojar un centenar de métricas, los sistemas DI modelan cómo las opciones conducen a resultados, y luego simulan escenarios antes de comprometerse.

Piense en ello como un análisis que responde a “¿Qué pasa si realmente hacemos esto?”, no sólo “¿qué pasó el último trimestre?” Los minoristas lo utilizan para probar estrategias de precios antes de su lanzamiento. Los bancos lo utilizan para simular la exposición al riesgo de sus carteras. Incluso los equipos de recursos humanos utilizan DI para predecir el impacto de la contratación y la retención antes de poner en marcha las políticas.

El mercado evidencia este cambio: el mercado mundial de inteligencia para la toma de decisiones se estimó en $15.220 millones en 2024 y se prevé que alcance $36.340 millones en 2030, con una tasa de crecimiento interanual anual del 15,4%.

Consejo profesional:

¿Cuál es el futuro de los macrodatos? 2026 aporta un nuevo nivel de madurez. Ahora hay que centrarse en elegir las herramientas y los métodos que realmente generen impacto. Las empresas que conecten la tecnología con objetivos claros verán un crecimiento más rápido y resultados más sólidos.

Utilice IA donde ahorre tiempo y mejore la precisión. Construya una malla de datos que ayude a los equipos a trabajar juntos en lugar de en silos. Invierta en análisis en tiempo real que le ayuden a actuar en el momento adecuado, no a posteriori.

Los líderes de este año entienden una cosa: el valor proviene de aplicar los datos con un propósito. Elige lo que mejor se adapte a tu estrategia, haz que funcione en todos los equipos y deja que los datos se conviertan en el motor que impulse cada movimiento inteligente que hagas.

Responsable de Big Data y IA

Philip aporta un enfoque nítido a todo lo relacionado con los datos y IA. Él es quien hace las preguntas correctas desde el principio, establece una sólida visión técnica y se asegura de que no solo construyamos sistemas inteligentes, sino que construyamos los correctos, para obtener un valor empresarial real.

Su mensaje ha sido enviado.

Procesaremos su solicitud y nos pondremos en contacto con usted lo antes posible.

Al registrarse, acepta nuestra Política de privacidadincluyendo el uso de cookies y la transferencia de su información personal.