Ihre Nachricht wurde gesendet.

Wir werden Ihre Anfrage bearbeiten und uns so schnell wie möglich mit Ihnen in Verbindung setzen.

Das Formular wurde erfolgreich abgeschickt.

Weitere Informationen finden Sie in Ihrem Briefkasten.

Sprache auswählen

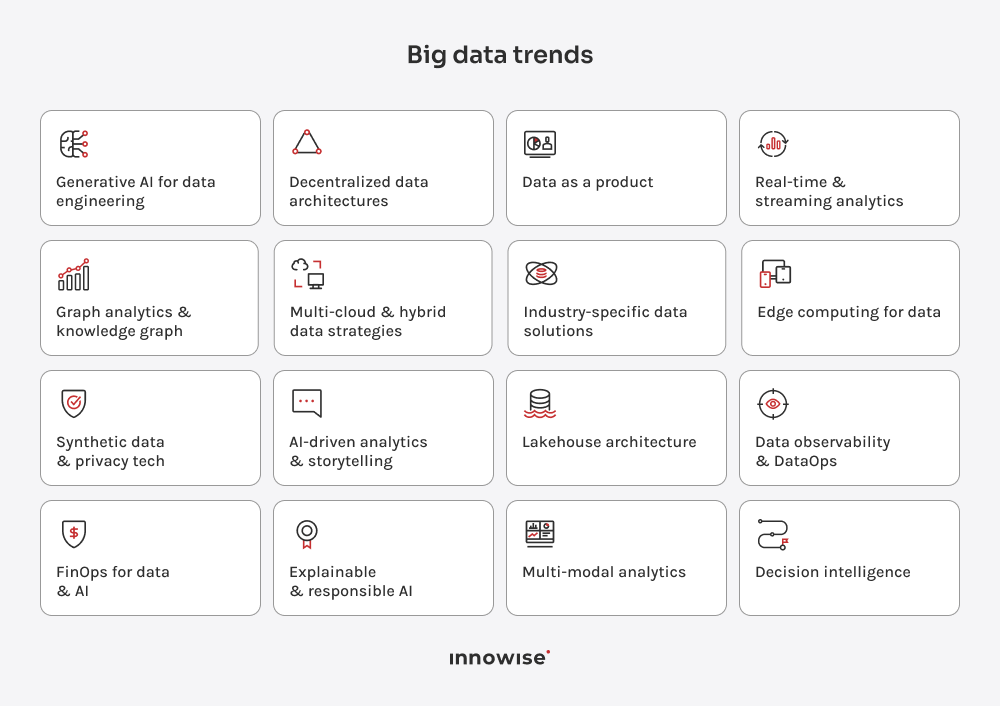

Lassen Sie mich die Dinge mit einer kühnen Behauptung einleiten: 2026 ist das Jahr der Abrechnung für die großen Datenindustrie. Wir haben das letzte Jahrzehnt damit verbracht, mit jeder glänzenden neuen Technologie zu experimentieren: AI, IoT, Cloud-Plattformen und all diese Schlagworte. Aber wissen Sie was? Es ist an der Zeit, etwas zu tun, sonst verpasst man den Anschluss. Wenn Ihr Unternehmen nicht bereits herausfindet, wie es diese riesige Datenflut in etwas Brauchbares umwandeln kann, werden Sie auf der Strecke bleiben.

2026 ist es an der Zeit, diese Instrumente für sich zu nutzen und der Zeit einen Schritt voraus zu sein. Sind Sie neugierig, welche Trends Sie beobachten sollten? Lassen Sie uns eintauchen.

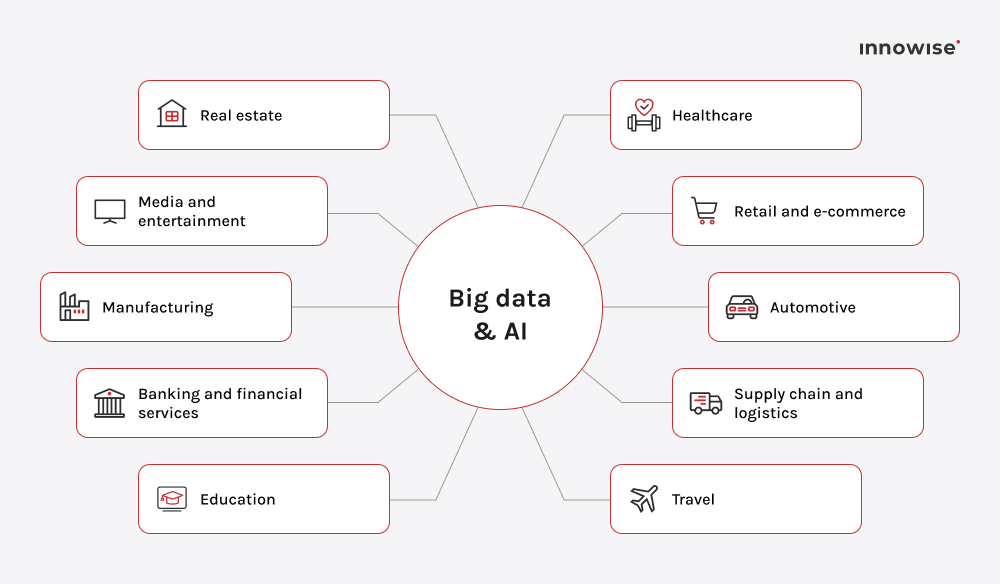

Im Jahr 2026, Big Data wird zu einem entscheidenden Faktor für die Wertschöpfung eines Unternehmens und wirkt sich auf alle Branchen aus. Von AI-gesteuerten Analyse-Copiloten bis hin zur Echtzeit-Edge-Verarbeitung - diese Trends definieren die Big Data-Zukunft die sich bereits entfalten. Sie werden Ihren geschäftlichen Erfolg bestimmen, also lesen Sie diesen Beitrag bis zum Ende.

Eine der wirkungsvollsten zukünftige Trends in der Big-Data-Analytik ist der Aufstieg des generativen AI. Obwohl es noch nicht perfekt ist, nimmt GenAI bereits die zeitaufwändigsten und mühsamsten Teile des Data Engineering in Angriff. AI wird die Herausforderungen der Datenqualität nicht vollständig beseitigen, aber es kann die Stunden, die Ihr Team mit der Datenvorbereitung verbringt, erheblich reduzieren.

AI wird jetzt in Datenpipelines eingebettet und ist in der Lage, Aufgaben wie die Datenbereinigung, das Auffüllen fehlender Lücken (Imputation) und die Datentransformation zu automatisieren. Das bedeutet, dass Sie in einem Bruchteil der Zeit über saubere, einsatzbereite Daten verfügen. Plattformen wie zum Beispiel Databricks und Snowflake enthalten bereits integrierte Funktionen für generative, AI-fähige Pipelines. Sie hilft Unternehmen bei der Automatisierung der Datenumwandlung, dem Füllen von Lücken und der Bereitstellung von AI-fähigen Datensätzen.

Profi-Tipp:

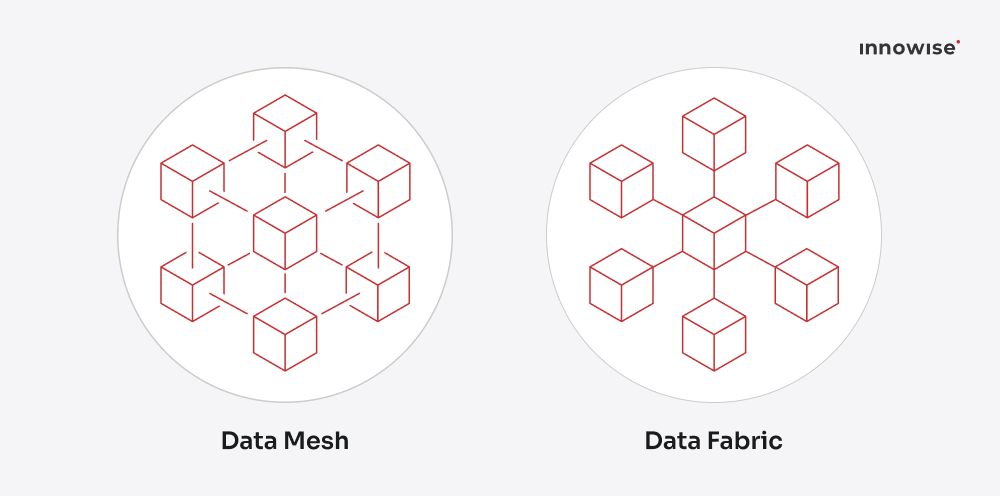

Wenn Sie sich auf veraltete Datenarchitekturen verlassen, werden Sie ausgebremst. Der Schlüssel zum Erhalt der Wettbewerbsfähigkeit ist die Einführung von Data Mesh und Data Fabric.

Data Mesh dezentralisiert das Dateneigentum, so dass die Domänenteams ihre eigenen Daten verwalten und bereitstellen können und der Engpass der zentralen IT wegfällt. Data Fabric verbindet alle Datenquellen (Cloud, On-Premise, Edge) zu einem kohärenten System mit automatisierten Metadaten, Lineage und Integration. Gemeinsam schaffen sie eine skalierbare, flexible Architektur, die Agilität ermöglicht, ohne die Kontrolle zu verlieren.

Das Wachstum des Data Mesh-Marktes (weltweit $5,09 Milliarden bis 2032) zeigt, wie schnell sich die Unternehmen auf dezentrale Datenmodelle umstellen.

Profi-Tipp:

Während das Data Mesh die Architektur Die Dezentralisierung funktioniert am besten, wenn sie mit einer “Daten-als-Produkt”-Mentalität kombiniert wird, bei der jeder Datensatz wie ein echtes Produkt behandelt, dokumentiert und verwaltet wird.

Data Mesh gibt Ihnen die Struktur. Daten als Produkt geben Ihnen Disziplin. Unter 2026, Intelligente Unternehmen dezentralisieren Daten nicht nur, sie verwalten sie wie ein Produkt, mit klaren Eigentumsverhältnissen, Dokumentation und messbarem Wert. Viele Unternehmen arbeiten zwar immer noch daran, ihre Daten zu zentralisieren, aber der Trend geht schnell weg von Daten, die in willkürlichen Tabellenkalkulationen oder isolierten Datenbanken vergraben sind. In einer Denkweise, in der Daten wie ein Produkt behandelt werden, gibt es für jeden Datensatz eine Dokumentation, eine Rollenzuweisung, Service-Level-Vereinbarungen und eine Feedbackschleife für Verbesserungen.

Auf diese Weise weiß das Marketing, wo seine Kampagnendaten gespeichert sind. Die Finanzabteilung kann sich auf die Umsatzzahlen verlassen, ohne dass ein “Datenabgleichstag” erforderlich ist. Und die Technik hört endlich auf, den Engpass zwischen den Dashboards aller anderen zu bilden.

Plattformen wie Snowflake Data Cloud und Databricks-Marktplatz helfen Teams bereits dabei, Datenprodukte intern oder mit Partnern zu veröffentlichen, gemeinsam zu nutzen und sogar zu vermarkten. Das öffnet neue Türen für die Zusammenarbeit und neue Einnahmequellen. Vor allem, wenn Ihr “Datenprodukt” zu etwas wird, das andere kaufen oder darauf aufbauen wollen.

Profi-Tipp:

"Bei Innowise sorgen wir stets dafür, dass Daten auf praktische und effiziente Weise für Sie arbeiten. Unser Ansatz integriert AI, automatisiert Daten-Workflows und ermöglicht Einblicke in Echtzeit, sodass Ihr Team nicht durch Komplexität behindert wird. Sie erhalten saubere, verwertbare Daten, wenn Sie sie brauchen, damit Sie Entscheidungen auf der Grundlage von Fakten treffen können.."

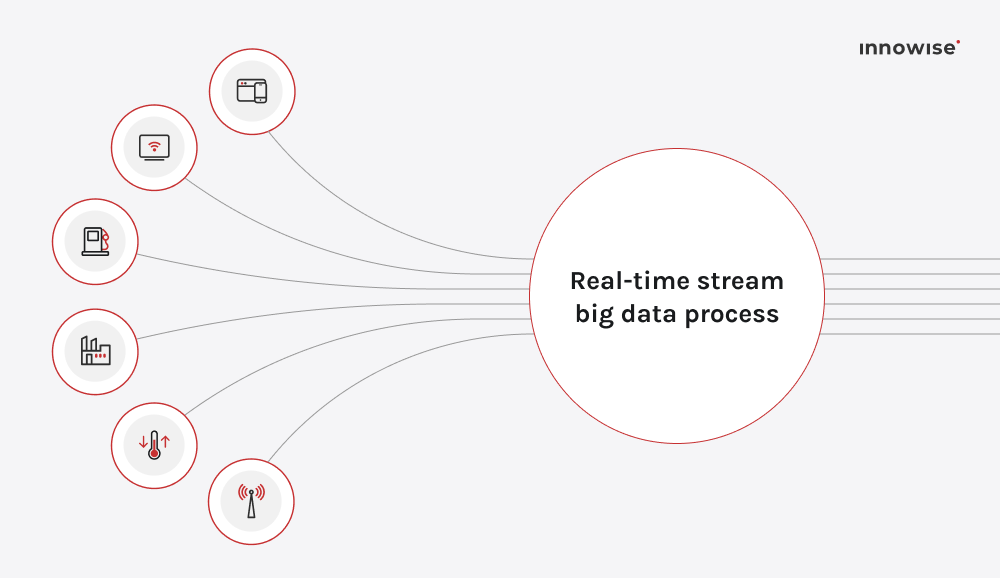

Der nächste auf der Liste der Zukunftstrends im Bereich Big Data ist Echtzeit-Analytik. Das Konzept befindet sich zwar seit Jahren in der Entwicklung, doch bis 2026 wird es sich rasch von einem Wettbewerbsvorteil zu einem zentrale Notwendigkeit für Unternehmen, die sofortige Einblicke benötigen. Wenn Sie Daten in dem Moment verarbeiten, in dem sie eintreffen, anstatt auf Stapel zu warten, können Sie auf Ereignisse, Signale und Muster reagieren wie sie geschehen. Für die Big-Data-Arena bedeutet dies Streaming großvolumiger Datenquellen (IoT-Sensoren, Benutzerinteraktionen, Protokolle) durch Pipelines, die innerhalb von Sekunden oder Millisekunden analysieren und reagieren.

Der Markt unterstützt diese Entwicklung. Der globale Sektor der Streaming-Analytik wurde auf einen Wert von $23,4 Milliarden im Jahr 2023 und soll bis 2030 auf etwa $ 128,4 Mrd. ansteigen, mit einer CAGR von etwa 28,3% zwischen 2024 und 2030. Branchen wie das Finanzwesen, die Telekommunikation, die Fertigung und der Einzelhandel nutzen bereits strömungsbasierte Modelle zur Betrugserkennung, dynamischen Preisgestaltung, vorausschauenden Wartung und Optimierung der Kundenerfahrung.

Profi-Tipp:

Wenn Ihre Datenstrategie die Echtzeit immer noch als “Extra” behandelt und sich zunächst stark auf Batch konzentriert, 2026 wird die Lücke aufzeigen, glauben Sie mir.

Die Graphenanalyse rückt im Jahr 2026 ins Rampenlicht, und zwar nicht als neue Technologie, sondern weil ihre Einführung durch die AI-Integration rasch beschleunigt wird. Anstatt Daten nur als Zeilen und Spalten zu behandeln, nutzen Unternehmen Graphen, um zu verstehen, wie Entitäten miteinander verbunden sind: Kunden, Produkte, Sensorknoten, Betrugsringe, was auch immer. Wissensgraphen und Graph-Datenbanken machen dies möglich: Sie bilden komplexe Zusammenhänge ab und bringen Erkenntnisse zutage, die mit traditionellen Methoden nur schwer zu erkennen sind. Zum Beispiel, ein Der jüngste Bericht von Verified Market Reports über die Graphikdatenbank erklärt dass Graphdatenbanken heute für die Echtzeitverarbeitung, semantische Beziehungen und die AI-gesteuerte Erkennung von Anomalien entscheidend sind.

Der wichtigste Vorteil für Unternehmensleiter ist folgender: Sie decken auf warum Dinge passieren, nicht nur entwickeltes GenAI-Modell, das sie passieren. Bei der Aufdeckung von Betrug erkennen Sie das Netz der Akteure, bei Empfehlungen bilden Sie verborgene Verbindungen ab, im Internet der Dinge verfolgen Sie Fehlerketten. Diese Leistung bringt tieferer Einblick, schnellere Erkennung, sowie mehr strategisches Handeln.

Profi-Tipp:

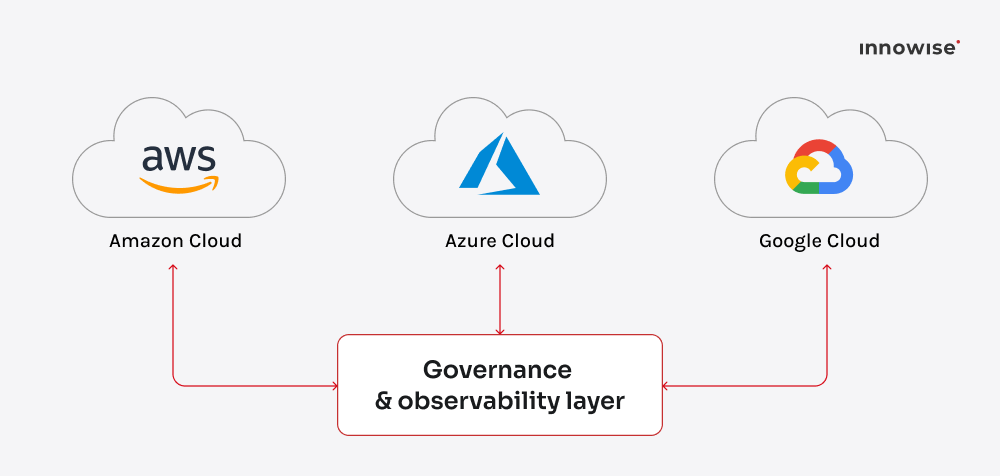

Im Jahr 2026 wird es zunehmend als Risiko angesehen, sich nur auf einen einzigen Cloud-Anbieter zu verlassen, ähnlich wie wenn man seine gesamte Investition in eine einzige Aktie steckt. Während viele Organisationen immer noch hauptsächlich eine Plattform nutzen, spielen die strategisch fortschrittlichsten Unternehmen jetzt das Multi-Cloud-Spiel. Sie balancieren Services von AWS, Azure und Google Cloud aus, um eine Bindung zu vermeiden und das beste Leistungs-Kosten-Verhältnis aus jeder Plattform herauszuholen.

Auch hybride Konfigurationen sind im Kommen. Hier kombinieren Unternehmen Cloud-Dienste mit ihren bestehenden Rechenzentren vor Ort. Die Gründe für diesen hybriden Ansatz reichen weiter als nur die Aufbewahrung sensibler Daten vor Ort:

Der Haken? Die Komplexität. Die Verteilung von Workloads auf verschiedene Clouds bringt mehr bewegliche Teile mit sich: unterschiedliche APIs, Abrechnungssysteme und Governance-Regeln. Die Gewinner sind diejenigen, die die Orchestrierungs- und Überwachungsebene automatisieren. Denken Sie an Cloud-übergreifende Abfrage-Engines, einheitliches Identitätsmanagement und Beobachtungstools, die Latenz und Kosten in Echtzeit verfolgen.

Profi-Tipp:

Allgemeine Datenplattformen sind großartig. Bis sie anfangen, nichts Bestimmtes zu lösen. Aus diesem Grund werden in 2026, Unternehmen in besonders wettbewerbsintensiven, risikoreichen oder regulierten Bereichen sind mit generischen Tools nicht mehr zufrieden. Sie wollen auf ihre Branche abgestimmte Lösungen, die ihre Sprache sprechen, ihre Vorschriften erfüllen und Ergebnisse liefern, anstatt Dashboards, die beeindruckend aussehen, aber wenig aussagen.

Warum also verlangen die Unternehmen plötzlich diese speziellen Lösungen in 2026? Im Grunde genommen geht es um drei große Dinge:

Gesundheitsteams wollen prädiktive Analytik die Ärzten helfen, Patientenrisiken zu erkennen, bevor sie eskalieren. Banken kümmern sich um die Aufdeckung von Betrug, Risikobewertung und hyper-personalisierte Angebote. Die Hersteller verfolgen den Zustand der Geräte und die Transparenz der Lieferkette auf die Minute genau. Und Einzelhändler mischen Transaktionsdaten mit Sensoren in den Geschäften und sozialen Trends, um die Nachfrage zu prognostizieren, ohne in Tabellenkalkulationen zu starren.

Deshalb verlagert sich der Markt in Richtung bereichsspezifische Datenprodukte: vorgefertigte Modelle, Konnektoren und Compliance-Frameworks, die sich direkt in reale Arbeitsabläufe einfügen. Diese Spezialisierung zeigt bereits ein massives Wachstum in vertikalen Märkten. Zum Beispiel, laut Visiongain, die Analytikmarkt im Gesundheitswesen allein wird $101 Milliarden erreichen bis 2031, die durch diese Art der Spezialisierung vorangetrieben wird.

Profi-Tipp:

Im Jahr 2026, ist die Forderung nach sofortigen, automatisierten Maßnahmen von größter Bedeutung. Obwohl die Cloud nach wie vor unverzichtbar ist, erkennen die Unternehmen, dass es zu viel Zeit und Geld kostet, die jedes einzelne Byte von Daten an einen entfernten Server zur Verarbeitung.

Edge Computing ist die Lösung. Es bringt die Datenverarbeitung näher an den Ort ihrer Entstehung: Sensoren, Maschinen, Geräte, sogar Autos. Anstatt Terabytes über das Netz zu schieben, verarbeiten Sie die wichtigen Daten lokal und handeln sofort.

Warum explodiert dieser Trend? jetzt?

Dies ist vor allem für Branchen von Bedeutung, in denen Schnelligkeit lebenswichtig ist: intelligente Fabriken, die Produktionslinien im Handumdrehen anpassen, Krankenhäuser, die Patienten in Echtzeit überwachen, oder Einzelhandelsketten, die ihre Preise dynamisch auf der Grundlage der lokalen Nachfrage gestalten. Und das Geld gibt uns Recht: IDC-Prognosen die weltweiten Ausgaben für Edge-Computing-Lösungen mit einem CAGR von ~13,8% wachsen und fast $380 Milliarden bis 2028.

Die intelligentesten Unternehmen ersetzen die Cloud nicht, sondern ergänzen sie. Sie verwenden eine hybride Konfiguration: lokale Verarbeitung für Geschwindigkeit, Cloud-Speicher für Skalierung. Das Ergebnis kann sich sehen lassen: geringere Latenzzeiten, geringere Bandbreitenkosten und schnellere Entscheidungen, die tatsächlich etwas bewirken.

Profi-Tipp:

Im Jahr 2026, Der Zugang zu realen Daten ist schwieriger denn je: Die Datenschutzgesetze sind strenger, die Aufsichtsbehörden sind wachsam und die Nutzer sind weit weniger nachsichtig. Deshalb brauchen wir synthetische Daten.

Der Trend explodiert jetzt, weil die GenAI Ausleger hat synthetische Daten endlich so hochwertig gemacht, dass sie komplexe, reale Informationen zuverlässig imitieren. Unternehmen verlassen sich zunehmend auf diese künstlichen, statistisch genauen Daten, um massive AI-Modelle schneller und kostengünstiger als mit herkömmlichen Methoden zu trainieren und dabei automatisch strenge Compliance-Anforderungen wie GDPR und das AI-Gesetz der EU zu erfüllen.

Tools für synthetische Daten sind allgegenwärtig: von Finanzunternehmen, die Betrugserkennungsmodelle trainieren, bis hin zu Gesundheitsunternehmen, die AI-Diagnosen durchführen, ohne Patientendaten preiszugeben. Gartner erwartet das bis 2030, Synthetische Daten werden beim AI-Training die realen Daten übertreffen, weil es sicherer, schneller und einfacher zu skalieren ist.

Profi-Tipp:

Im Jahr 2026, Analytik fühlt sich endlich menschlich an. AI Copilots und narrative Visualisierungstools verwandeln Daten jetzt in klare Geschichten statt in endlose Diagramme. Tools wie Power BI Copilot, Tableau GPT, camelAI, und die GenAI-Schicht von Looker können Erkenntnisse abfragen, zusammenfassen und in einfacher Sprache erklären.

Betrachten Sie sie als Ihre Datenanalysten. Sie können fragen: “Wie hat sich der Umsatz in diesem Quartal entwickelt?” oder “Welche Kampagne hat den höchsten ROI gebracht?” und erhalten sofortige Antworten in einfacher Sprache. Tools wie Power BI Kopilot, Tableau GPT, sowie kamelAI tun dies bereits und verbinden große Sprachmodelle direkt mit den Daten Ihres Unternehmens.

Profi-Tipp:

Im Jahr 2026, hat sich die Grenze zwischen Data Lakes und Warehouses verwischt. Der neue Standard ist lakehouse architecture, Dabei handelt es sich um ein Hybridmodell, das die Skalierbarkeit von Data Lakes mit der Struktur und Leistung von Warehouses kombiniert. Sie können unstrukturierte Daten speichern, sie mit SQL abfragen und maschinelle Lernprozesse ausführen. Alles an einem Ort. Ohne mit zehn verschiedenen Plattformen zu jonglieren.

Anbieter wie Databricks, Snowflake, sowie Google BigQuery sind hier tonangebend.

Profi-Tipp:

Im Jahr 2026, Die Verwaltung von Datenpipelines ohne Beobachtungsmöglichkeit ist wie ein Flugzeug, bei dem das Armaturenbrett ausgeschaltet ist. Sie können sich zwar schnell bewegen, aber Sie haben keine Ahnung, was passiert. Mit der Datenbeobachtung erhalten Teams Einblick in den Zustand, die Aktualität und die Zuverlässigkeit ihrer Daten. So wissen Sie, wann etwas nicht in Ordnung ist, warum es passiert ist und wie Sie es beheben können, bevor die Dashboards Unsinn anzeigen.

Warum ist dies also so wichtig? jetzt? Weil es ohne sie keine Governance oder Compliance gibt.

Dies geht Hand in Hand mit DataOps, wodurch Dinge wie Tests und Bereitstellung automatisiert werden. Zusammen bieten Observability und DataOps ein zuverlässiges, konformes und grundsolides Daten-Backbone mit weniger Überraschungen und schnelleren Wiederherstellungszeiten.

Profi-Tipp:

Haben Sie schon einmal nachts wegen Cloud-Rechnungen wach gelegen? Die Datenmengen explodieren und die AI-Workloads nehmen zu, FinOps (Finanzoperationen für Cloud und Daten) ist unerlässlich. Das Ziel ist einfach: Sie müssen verstehen, wohin jeder Dollar in Ihrem Daten-Ökosystem fließt, und sicherstellen, dass er tatsächlich in den Kauf von Geschäftswerten fließt und nicht nur in größere Server.

Das Trainieren großer Modelle, das Speichern von Daten im Petabyte-Bereich und das Ausführen endloser Abfragen können das Budget schnell belasten. FinOps-Teams nutzen jetzt Analysen und Automatisierung, um Kosten in Echtzeit verfolgen, Ineffizienzen zu erkennen und die Nutzung abteilungsübergreifend zu prognostizieren. Cloud-Anbieter bieten sogar native Tools dafür an (AWS Cost Explorer, Google Cloud Billing, Azure Cost Management), aber die wirklichen Vorteile ergeben sich aus der Integration von Finanzmetriken direkt in Ihre Daten-Workflows.

Profi-Tipp:

Im Jahr 2026, Das AI ist für so viele Geschäftsabläufe verantwortlich, dass es nicht mehr ausreicht, dem Modell zu vertrauen. Vorstände, Aufsichtsbehörden und Kunden erwarten alle Transparenz. Sie wollen wissen warum ein Algorithmus hat eine Entscheidung getroffen, nicht nur das Ergebnis. Deshalb Erklärbar AI (XAI) und Verantwortlich AI sind auf dem Vormarsch. Zusammen machen sie das maschinelle Lernen weniger zu einer Blackbox und mehr zu einem System, das Sie steuern können.

Banken verwenden bereits erklärbare Modelle um Kreditentscheidungen gegenüber Wirtschaftsprüfern zu rechtfertigen. Gesundheitsdienstleister sind auf sie angewiesen um zu zeigen, wie Diagnosealgorithmen zu Schlussfolgerungen kommen. Sogar HR-Systeme stehen auf dem Prüfstand, um Fairness bei Einstellungsempfehlungen zu beweisen. Wenn Entscheidungen Menschen oder Gewinne betreffen, ist blindes Vertrauen in AI keine Strategie, sondern ein Risiko.

Profi-Tipp:

Bis 2026, Big-Data-Entwicklung wird über Tabellen und Dashboards hinausgehen und eine neue Ära der multimodalen Analyse einleiten. Hier werden Text-, Bild-, Video- und Sensordaten kombiniert, um ein vollständiges, kontextreiches Bild zu erstellen. Anstatt Kundenfeedback und Verkaufszahlen getrennt zu analysieren, können Teams nun Anrufprotokolle, Produktfotos und Benutzerverhalten in einem einzigen Arbeitsbereich miteinander in Beziehung setzen.

Klingt nach Science-Fiction, oder? Aber Plattformen wie Datenbausteine MosaicML, Anthropic's Claude für Daten, sowie OpenAI's GPT-4 Turbo mit Weitblick bereits Multiformat-Dateneingaben verarbeiten. Das Ergebnis ist beeindruckend. Die kontextbezogenen Erkenntnisse fühlen sich fast intuitiv an. Stellen Sie sich vor, Sie könnten Anlagenausfälle vorhersagen, indem Sie Schwingungsprotokolle, Wärmebilder und Wartungsnotizen miteinander vergleichen. Das ist es, was die multimodale Analyse ermöglicht.

Profi-Tipp:

Und der letzte auf der Liste der wichtige Trends im Bereich Big Data sind Entscheidungsintelligenz (DI). Sie mischt Datenwissenschaft, Psychologie und Geschäftslogik, um Unternehmen zu helfen, schneller kluge Entscheidungen zu treffen. Anstatt Ihnen hundert Metriken vorzulegen, modellieren DI-Systeme, wie Entscheidungen zu Ergebnissen führen, und simulieren dann Szenarien, bevor Sie sich festlegen.

Betrachten Sie es als Analytik, die Antworten gibt “Was passiert, wenn wir das tatsächlich tun?”, nicht nur “Was ist im letzten Quartal passiert?” Einzelhändler nutzen es, um Preisstrategien vor der Markteinführung zu testen. Banken nutzen es, um das Risiko in verschiedenen Portfolios zu simulieren. Sogar HR-Teams nutzen DI, um die Auswirkungen auf die Einstellung und Bindung von Mitarbeitern vorherzusagen, bevor Richtlinien in Kraft treten.

Der Markt beweist diese Verschiebung: der globale Markt für Decision Intelligence wurde für 2024 auf $15,22 Milliarden geschätzt geschätzt und soll $36,34 Milliarden bis 2030, mit einer CAGR von etwa 15,4% wachsen.

Profi-Tipp:

Was ist also die Zukunft von Big Data? 2026 bringt einen neuen Reifegrad mit sich. Der Schwerpunkt liegt jetzt auf der Auswahl der Werkzeuge und Methoden, die tatsächlich Wirkung zeigen. Unternehmen, die Technologie mit klaren Zielen verbinden, werden ein schnelleres Wachstum und bessere Ergebnisse erzielen.

Setzen Sie AI dort ein, wo es Zeit spart und die Genauigkeit verbessert. Bauen Sie ein Datengeflecht auf, das den Teams hilft, zusammenzuarbeiten, anstatt in Silos zu arbeiten. Investieren Sie in Echtzeit-Analysen, die Ihnen helfen, im richtigen Moment zu handeln, nicht erst im Nachhinein.

Die Führungskräfte dieses Jahres haben eines verstanden: Wert entsteht durch den gezielten Einsatz von Daten. Wählen Sie aus, was zu Ihrer Strategie passt, sorgen Sie dafür, dass es teamübergreifend funktioniert, und lassen Sie Daten zum Motor werden, der jeden intelligenten Schritt antreibt, den Sie machen.

Leiter für Big Data und KI

Philip bringt einen scharfen Blick für alles, was mit Daten und KI zu tun hat. Er ist derjenige, der frühzeitig die richtigen Fragen stellt, eine starke technische Vision entwickelt und dafür sorgt, dass wir nicht nur intelligente Systeme bauen, sondern die richtigen, die einen echten geschäftlichen Nutzen bringen.

Ihre Nachricht wurde gesendet.

Wir werden Ihre Anfrage bearbeiten und uns so schnell wie möglich mit Ihnen in Verbindung setzen.

Mit der Anmeldung erklären Sie sich mit unseren Datenschutzerklärung