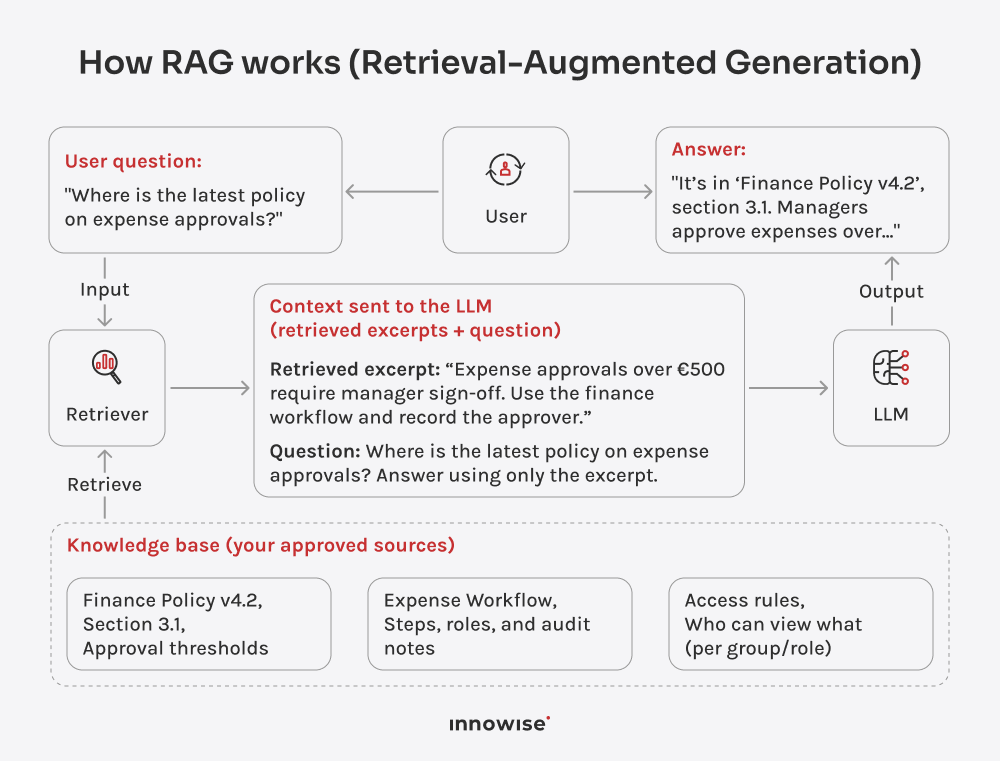

Chatbot RAG może korzystać z dokumentów wewnętrznych, artykułów bazy wiedzy, stron wiki, treści pomocy technicznej i innych zatwierdzonych źródeł tekstu. Kluczem jest kontrola nad źródłami i regułami dostępu.

Wiadomość została wysłana.

Przetworzymy Twoją prośbę i skontaktujemy się z Tobą tak szybko, jak to możliwe.