A sua mensagem foi enviada.

Processaremos o seu pedido e contactá-lo-emos logo que possível.

O formulário foi enviado com sucesso.

Encontrará mais informações na sua caixa de correio.

Selecionar a língua

Permitam-me que comece com uma afirmação ousada: 2026 é o ano do ajuste de contas para os grandes sector dos dados. Passámos a última década a fazer experiências com todas as novas tecnologias brilhantes que existem: IA, IoT, plataformas de nuvem e todas essas palavras-chave. Mas adivinha? Está na altura de se levantar ou vai perder o barco. Se a sua empresa ainda não está a tentar descobrir como transformar essa enorme quantidade de dados em algo utilizável, vai ficar para trás.

2026 é o momento de fazer com que estas ferramentas trabalhem para si e se mantenham à frente da curva. Curioso sobre quais as tendências a observar? Vamos mergulhar no assunto.

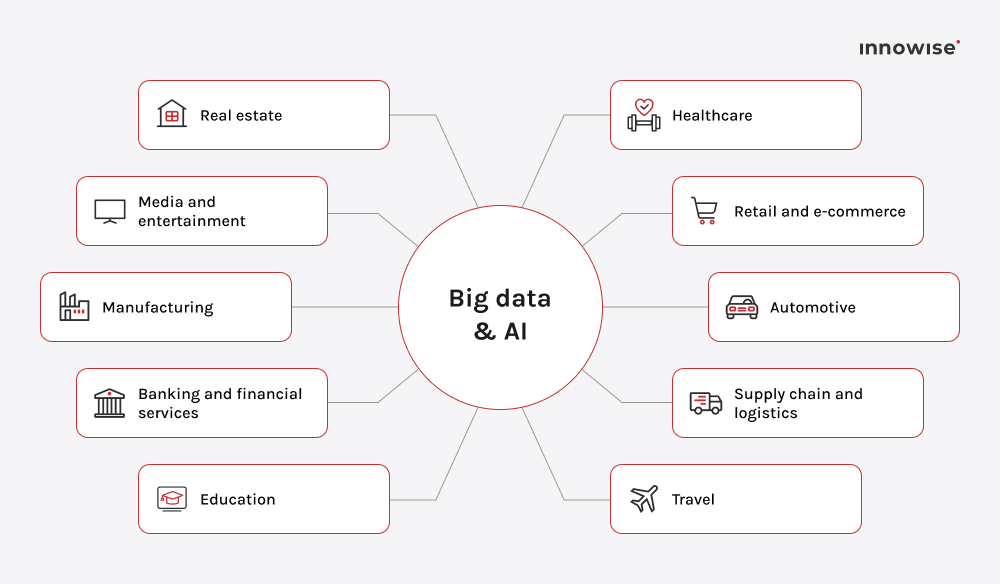

Em 2026, Quando o Big Data se torna um dos principais impulsionadores do valor comercial, ele tem impacto em todos os sectores. Desde copilotos analíticos orientados para o IA até ao processamento de ponta em tempo real, estas tendências definem o o futuro dos grandes dados que já se está a desenrolar. Elas irão moldar o sucesso do seu negócio, por isso leia este artigo até ao fim.

Um dos mais impactantes tendências futuras da análise de grandes volumes de dados é o surgimento do AI generativo. Embora ainda não seja perfeito, o GenAI já está a lidar com as partes mais demoradas e entediantes da engenharia de dados. O IA não eliminará totalmente os desafios da qualidade dos dados, mas pode reduzir significativamente as horas que a sua equipa gasta na preparação dos dados.

O IA está agora a ser incorporado em pipelines de dados, capaz de automatizar tarefas como a limpeza de dados, o preenchimento de lacunas em falta (imputação) e a transformação de dados. Isto significa que terá dados limpos e prontos a utilizar numa fração de tempo. Por exemplo, plataformas como Databricks e Snowflake já incluem funcionalidades incorporadas para pipelines generativos compatíveis com o IA. Ajuda as organizações a automatizar a transformação de dados, o preenchimento de lacunas e a entrega de conjuntos de dados prontos para o IA.

Dica profissional:

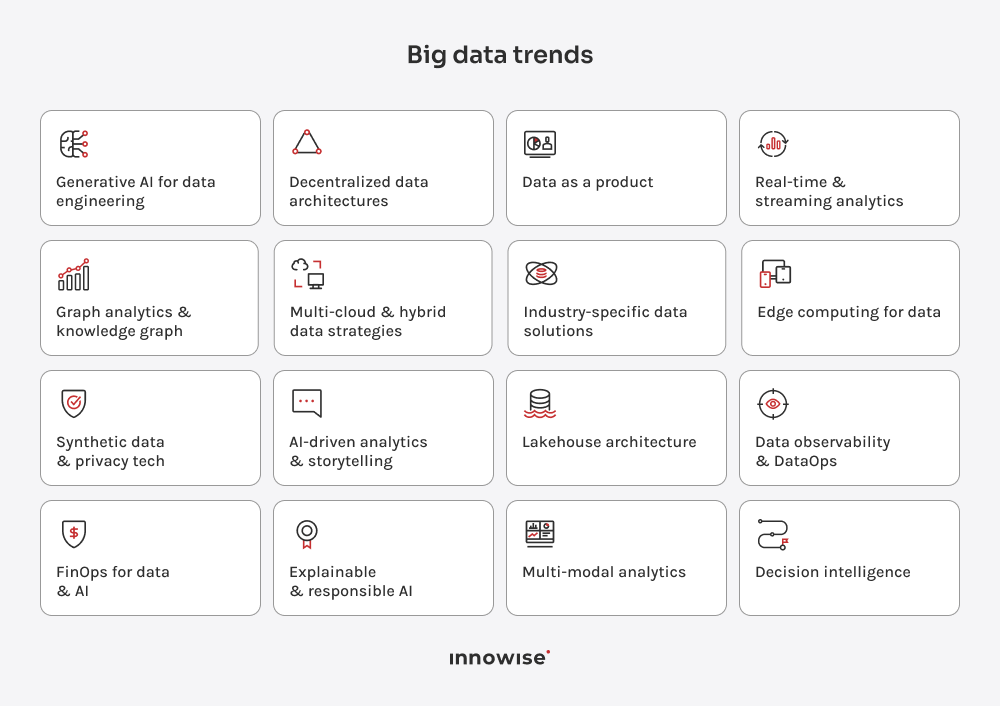

Confiar em arquitecturas de dados desactualizadas é um obstáculo. A chave para se manter competitivo é adotar o Data Mesh e o Data Fabric.

Data Mesh descentraliza a propriedade dos dados, permitindo às equipas de domínio gerir e servir os seus próprios dados, eliminando o estrangulamento do IT central. Data Fabric conecta todas as fontes de dados (cloud, on-prem, edge) em um sistema coeso com metadados, linhagem e integração automatizados. Juntos, criam uma arquitetura escalável e flexível que permite agilidade sem sacrificar o controlo.

O crescimento do mercado de Data Mesh (projetada para atingir $5,09 mil milhões até 2032) mostra a rapidez com que as empresas estão a mudar para modelos de dados descentralizados.

Dica profissional:

Enquanto o Data Mesh define o arquitetura para a descentralização, funciona melhor quando combinada com uma mentalidade de “dados como um produto”, em que cada conjunto de dados é propriedade, documentado e gerido como um produto real.

A malha de dados dá-lhe a estrutura. Os dados como um produto proporcionam-lhe disciplina. Em 2026, As empresas inteligentes não se limitam a descentralizar os dados, gerem-nos como um produto, com propriedade clara, documentação e valor mensurável. Embora muitas empresas ainda estejam a trabalhar para centralizar os seus dados, a tendência está a afastar-se rapidamente dos dados enterrados em folhas de cálculo aleatórias ou bases de dados isoladas. Numa mentalidade de dados como um produto, cada conjunto de dados tem documentação, atribuição de funções, acordos de nível de serviço e um ciclo de feedback para melhoria.

Desta forma, o marketing sabe onde se encontram os dados das suas campanhas. O departamento financeiro confia nos números das receitas sem precisar de um “dia de reconciliação de dados”. E a engenharia deixa finalmente de ser o ponto de estrangulamento entre os painéis de todos os outros.

Plataformas como Snowflake Data Cloud e Mercado da Databricks já ajudam as equipas a publicar, partilhar e até rentabilizar produtos de dados internamente ou com parceiros. Isto abre novas portas para a colaboração e novos fluxos de receitas. Especialmente quando o seu “produto de dados” se torna algo que outros querem comprar ou desenvolver.

Dica profissional:

"No Innowise, certificamo-nos sempre de que os dados trabalham para si de uma forma prática e eficiente. A nossa abordagem integra o IA, automatiza os fluxos de trabalho de dados e permite a obtenção de informações em tempo real, para que a sua equipa não seja prejudicada pela complexidade. Obtém dados limpos e acionáveis quando precisa deles, para que possa tomar decisões baseadas em factos."

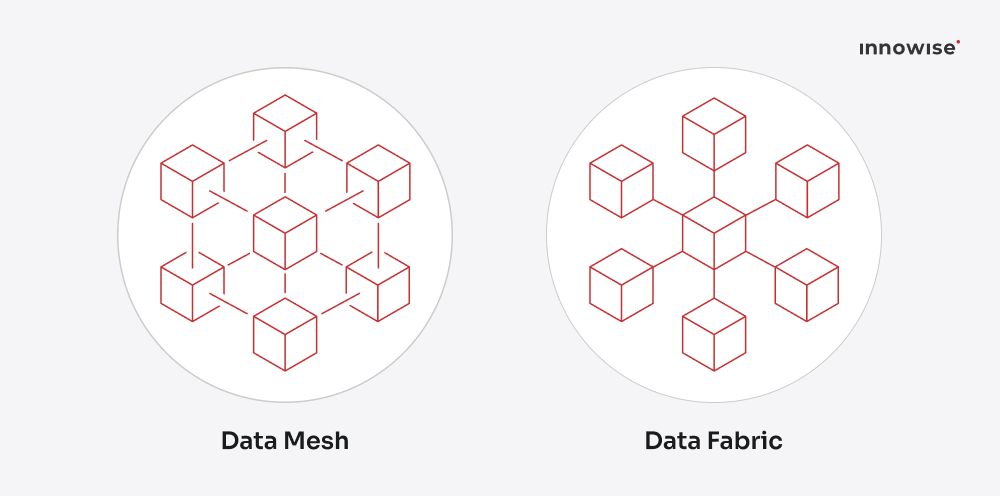

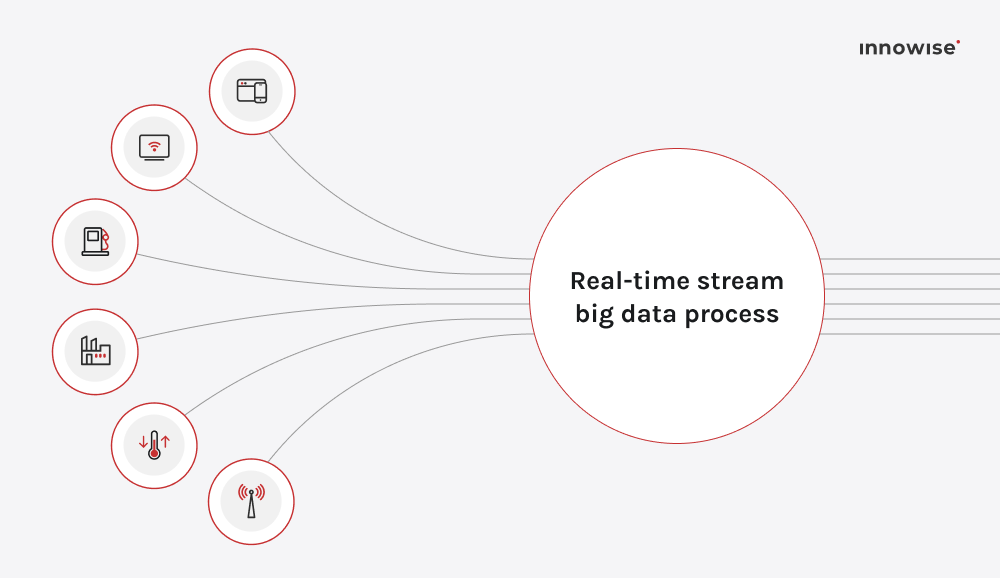

O próximo na lista de as tendências futuras dos grandes dados são análise em tempo real. Embora o conceito esteja a ser desenvolvido há anos, até 2026, estará a evoluir rapidamente de uma vantagem competitiva para uma necessidade fundamental para organizações que exigem percepções instantâneas. Quando processa os dados no momento em que chegam, em vez de esperar por lotes, desbloqueia a capacidade de atuar sobre eventos, sinais e padrões à medida que vão acontecendo. No domínio dos grandes volumes de dados, isto significa streaming de fontes de dados de grande volume (sensores IoT, interações dos utilizadores, registos) através de pipelines de dados que analisam e respondem em segundos ou milissegundos.

O mercado apoia esta mudança. O sector global da análise de fluxo contínuo foi avaliado em $23,4 mil milhões em 2023 e prevê-se que cresça para cerca de $ 128,4 mil milhões até 2030, com uma taxa de crescimento anual de cerca de 28,3% entre 2024 e 2030. Sectores como o financeiro, as telecomunicações, a indústria transformadora e o retalho já estão a utilizar modelos baseados em fluxos para deteção de fraudes, fixação dinâmica de preços, manutenção preditiva e otimização da experiência do cliente.

Dica profissional:

Se a sua estratégia de dados ainda trata o tempo real como um “extra” e se concentra fortemente no lote primeiro, 2026 vai realçar a lacuna, acreditem em mim.

A análise de grafos está no centro das atenções em 2026, não como uma nova tecnologia, mas porque a sua adoção está a ser rapidamente acelerada pela integração IA. Em vez de tratar os dados apenas como linhas e colunas, as organizações utilizam gráficos para compreender como as entidades se interligam: clientes, produtos, nós de sensores, anéis de fraude, etc. Gráficos de conhecimento e bases de dados de grafos tornam isto possível: mapeiam relações complexas e expõem informações que os métodos tradicionais têm dificuldade em revelar. Por exemplo, um O recente relatório da base de dados de gráficos da Verified Market Reports explica que as bases de dados de grafos são atualmente essenciais para o processamento em tempo real, as relações semânticas e a deteção de anomalias orientada para o IA.

Para os líderes empresariais, a principal vantagem é a seguinte: descobrem-se porquê as coisas acontecem, não apenas que acontecem. Na deteção de fraudes, é possível detetar a rede de intervenientes; na recomendação, é possível mapear afinidades ocultas; na IdC, é possível rastrear cadeias de falhas. Esse poder traz visão mais profunda, deteção mais rápida, e ação mais estratégica.

Dica profissional:

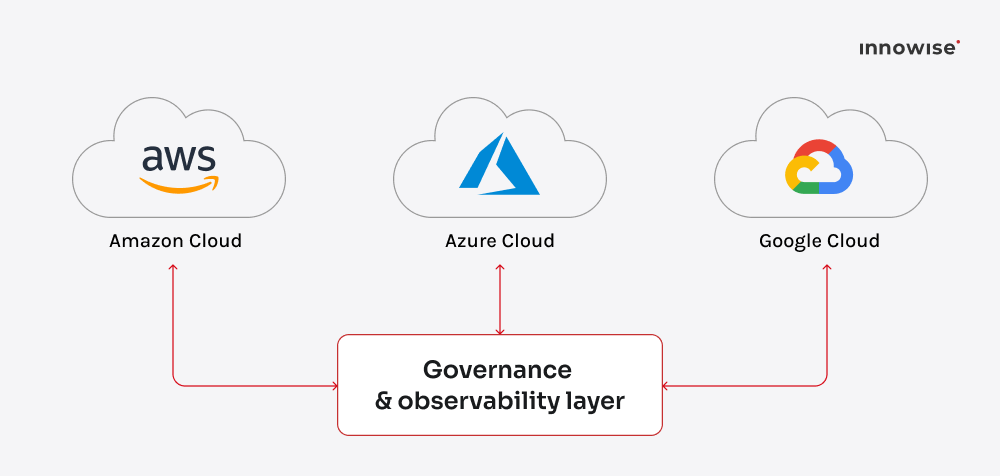

Em 2026, depender apenas de um único fornecedor de serviços em nuvem é cada vez mais visto como um risco, tal como colocar todo o seu investimento numa única ação. Embora muitas organizações ainda usem principalmente uma plataforma, as empresas mais avançadas estrategicamente agora jogam o jogo de várias nuvens. Elas equilibram os serviços da AWS, Azure e Google Cloud para evitar a dependência e obter a melhor relação desempenho/custo de cada um.

As configurações híbridas também estão a aumentar. É aqui que as organizações combinam serviços de nuvem com os seus centros de dados locais existentes. As razões para esta abordagem híbrida são mais profundas do que apenas manter os dados confidenciais no local:

O senão? Complexidade. A distribuição de cargas de trabalho entre nuvens introduz mais partes móveis: diferentes APIs, sistemas de faturação e regras de governação. Os vencedores são aqueles que automatizam a camada de orquestração e monitoramento. Pense em mecanismos de consulta entre nuvens, gerenciamento de identidade unificado e ferramentas de observabilidade que rastreiam a latência e o custo em tempo real.

Dica profissional:

As plataformas de dados genéricas são óptimas. Até começarem a não resolver nada em particular. É por isso que, em 2026, Nas empresas que operam em sectores super-competitivos, de alto risco ou regulamentados, as ferramentas genéricas já não são suficientes. Pretendem soluções adaptadas à indústria que falem a sua língua, tratem dos seus regulamentos e apresentem resultados, em vez de painéis de controlo que parecem impressionantes mas pouco significam.

Então, porque é que as empresas estão subitamente a exigir estas soluções especializadas em 2026? Resume-se, de facto, a três grandes coisas:

As equipas de cuidados de saúde querem análises preditivas que ajudam os médicos a detetar os riscos dos doentes antes de estes se agravarem. Os bancos preocupam-se com a deteção de fraudes, A empresa pode oferecer aos seus clientes uma gama completa de serviços, incluindo a avaliação de riscos e ofertas hiper-personalizadas. Os fabricantes monitorizam o estado do equipamento e a visibilidade da cadeia de fornecimento ao minuto. E os retalhistas estão a combinar dados de transacções com sensores na loja e tendências sociais para prever a procura sem ter de olhar para folhas de cálculo.

É por isso que o mercado está a mudar para produtos de dados específicos do domínio: modelos pré-construídos, conectores e estruturas de conformidade que se encaixam diretamente em fluxos de trabalho reais. Esta especialização já está a demonstrar um crescimento maciço nos mercados verticais. Por exemplo, de acordo com a Visiongain, a mercado da análise dos cuidados de saúde por si só atingirá $101 mil milhões até 2031, impulsionado por este tipo de especialização.

Dica profissional:

Em 2026, No entanto, a procura de acções imediatas e automatizadas é fundamental. Embora a nuvem continue a ser vital, as empresas estão a aperceber-se de que custa demasiado tempo e dinheiro enviar cada byte de dados para um servidor distante para processamento.

A computação periférica é a solução. Aproxima o processamento de dados do local onde são gerados: sensores, máquinas, dispositivos e até automóveis. Em vez de empurrar terabytes através da rede, processa os dados importantes localmente e actua instantaneamente.

Porque é que esta tendência está a explodir agora?

Isto é mais importante para as indústrias em que a velocidade é vital: fábricas inteligentes que ajustam as linhas de produção em tempo real, hospitais que monitorizam os doentes em tempo real ou cadeias de retalho que gerem os preços de forma dinâmica com base na procura local. E o dinheiro apoia-o: Previsões da IDC as despesas globais em soluções de computação periférica crescerão a uma taxa de crescimento anual de ~13,8% e atingirão quase $380 mil milhões até 2028.

As organizações mais inteligentes não estão a substituir a nuvem; estão a completá-la. Elas usam uma configuração híbrida: processamento local para velocidade, armazenamento em nuvem para escala. O resultado é fantástico: latência mais baixa, custos de largura de banda reduzidos e decisões mais rápidas que realmente fazem a diferença.

Dica profissional:

Em 2026, No entanto, o acesso a dados do mundo real é mais complicado do que nunca: as leis de privacidade são mais rigorosas, os reguladores estão atentos e os utilizadores são muito menos tolerantes. É por isso que precisamos de dados sintéticos.

A tendência está a explodir agora porque o Lança GenAI finalmente tornou os dados sintéticos de alta qualidade o suficiente para imitar de forma confiável informações complexas do mundo real. As empresas estão a confiar cada vez mais nestes dados artificiais e estatisticamente exactos para treinar modelos IA maciços de forma mais rápida e barata do que os métodos tradicionais, satisfazendo automaticamente as necessidades de conformidade exigentes, como o RGPD e a Lei IA da UE.

As ferramentas de dados sintéticos estão em todo o lado: desde empresas financeiras que treinam modelos de deteção de fraudes a empresas de cuidados de saúde que executam diagnósticos IA sem expor os dados dos pacientes. A Gartner prevê que até 2030, os dados sintéticos ultrapassarão os dados reais na formação IA, porque é mais seguro, mais rápido e mais fácil de escalar.

Dica profissional:

Em 2026, A análise finalmente parece humana. Os copilotos IA e as ferramentas de visualização narrativa transformam agora os dados em histórias claras em vez de gráficos intermináveis. Ferramentas como o Copiloto Power BI, Tableau GPT, camelAI, e a camada GenAI da Looker pode consultar, resumir e explicar os insights em linguagem simples.

Pense neles como o seu analista de dados. Pode perguntar: “Qual foi a evolução das receitas neste trimestre?” ou “Qual foi a campanha que gerou o ROI mais elevado?” e obter respostas imediatas em linguagem simples. Ferramentas como Power BI Copiloto, Tableau GPT, e cameloAI já o fazem, ligando grandes modelos linguísticos diretamente aos dados da sua empresa.

Dica profissional:

Em 2026, A linha entre os lagos de dados e os armazéns esbateu-se. O novo padrão é lakehouse architecture, que é um modelo híbrido que combina a escalabilidade dos lagos de dados com a estrutura e o desempenho dos armazéns. Pode armazenar dados não estruturados, consultá-los com SQL e executar cargas de trabalho de aprendizagem automática. Tudo num só lugar. Sem ter de fazer malabarismos com dez plataformas diferentes.

Fornecedores como Databricks, Snowflake, e Google BigQuery estão a liderar o processo.

Dica profissional:

Em 2026, Gerir pipelines de dados sem observabilidade é como pilotar um avião com o painel de instrumentos desligado. Pode andar depressa, mas não faz ideia do que está a acontecer. A observabilidade dos dados é a forma como as equipas obtêm visibilidade sobre a saúde, a atualidade e a fiabilidade dos seus dados. Indica quando algo está errado, porque aconteceu e como corrigir o problema antes que os painéis comecem a mostrar disparates.

Então, porque é que isto é essencial agora? Porque não se pode ter governação ou conformidade sem isso.

Isto vai a par com DataOps, que automatiza coisas como testes e implantação. Em conjunto, a observabilidade e o DataOps proporcionam-lhe uma espinha dorsal de dados fiável, compatível e sólida, com menos surpresas e tempos de recuperação mais rápidos.

Dica profissional:

As contas da nuvem já o deixaram acordado à noite? À medida que os volumes de dados explodem e as cargas de trabalho IA se multiplicam, FinOps (operações financeiras para nuvem e dados) torna-se essencial. O objetivo é simples: compreender para onde vai cada dólar do seu ecossistema de dados e garantir que está realmente a comprar valor comercial, e não apenas servidores maiores.

O treino de modelos de grande dimensão, o armazenamento de petabytes de dados e a execução de consultas intermináveis podem esgotar rapidamente os orçamentos. As equipas FinOps utilizam agora a análise e a automatização para acompanhar os custos em tempo real, AWS Cost Explorer, o Cloud Billing e o Azure Cost Management são ferramentas nativas para isso. Os fornecedores de Cloud até oferecem ferramentas nativas para este efeito (AWS Cost Explorer, Google Cloud Billing, Azure Cost Management), mas os ganhos reais advêm da integração de métricas financeiras diretamente nos seus fluxos de trabalho de dados.

Dica profissional:

Em 2026, O IA gere uma parte tão grande do negócio que “confiar apenas no modelo” já não é suficiente. As direcções, os reguladores e os clientes esperam transparência. Eles querem saber porquê um algoritmo tomou uma decisão, não apenas o resultado. É por isso que Explicável IA (XAI) e Responsável IA estão a ganhar força. Em conjunto, tornam a aprendizagem automática menos uma caixa negra e mais um sistema que pode ser gerido.

Os bancos já utilizam modelos explicáveis para justificar as decisões de crédito aos auditores. Os prestadores de cuidados de saúde confiam neles para mostrar como os algoritmos de diagnóstico chegam a conclusões. Até os sistemas de RH estão a ser analisados para provar a equidade das recomendações de contratação. Quando as decisões afectam pessoas ou lucros, a fé cega no IA não é estratégia; é um risco.

Dica profissional:

Até 2026, desenvolvimento de grandes volumes de dados irá ultrapassar as tabelas e os painéis de controlo e entrar numa nova era de análise multimodal. Aqui, texto, imagens, vídeo e dados de sensores combinam-se para criar uma imagem completa e rica em contexto. Em vez de analisar separadamente o feedback dos clientes e os números de vendas, as equipas podem agora correlacionar transcrições de chamadas, fotografias de produtos e o comportamento dos utilizadores num único espaço de trabalho.

Parece ficção científica, certo? Mas plataformas como MosaicML da Databricks, O pedido de dados do Anthropic, e OpenIA's GPT-4 Turbo com visão já tratam de entradas de dados em vários formatos. O resultado é fantástico. Os conhecimentos ricos em contexto parecem quase intuitivos. Imagine prever falhas no equipamento através da análise cruzada de registos de vibração, imagens térmicas e notas de manutenção. É isso que a análise multimodal permite.

Dica profissional:

E o último da lista de principais tendências em grandes volumes de dados é inteligência de decisão (DI). Esta combina ciência de dados, Os sistemas de DI são baseados em dados de psicologia, psicologia e lógica de negócios para ajudar as organizações a tomar decisões mais inteligentes e mais rápidas. Em vez de lhe apresentar uma centena de métricas, os sistemas DI modelam a forma como as escolhas conduzem aos resultados e, em seguida, simulam cenários antes de se comprometer.

Pense nisto como uma análise que responde “O que acontece se fizermos mesmo isto?”, e não apenas “O que aconteceu no último trimestre?” Os retalhistas utilizam-no para testar estratégias de preços antes do lançamento. Os bancos utilizam-no para simular a exposição ao risco nas carteiras. Até as equipas de RH utilizam a DI para prever o impacto na contratação e retenção antes de as políticas entrarem em vigor.

O mercado evidencia esta mudança: o mercado global de decision intelligence foi estimado em $15,22 mil milhões em 2024 e prevê-se que atinja $36,34 mil milhões de euros até 2030, com um crescimento de cerca de 15,4% CAGR.

Dica profissional:

Então, qual é o futuro dos grandes dados? 2026 traz-lhe um novo nível de maturidade. A tónica é agora colocada na escolha das ferramentas e dos métodos que criam efetivamente impacto. As empresas que associam a tecnologia a objectivos claros registarão um crescimento mais rápido e resultados mais sólidos.

Utilize o IA onde ele economiza tempo e melhora a precisão. Crie uma rede de dados que ajude as equipas a trabalhar em conjunto e não em silos. Invista em análises em tempo real que o ajudem a agir no momento certo e não após o facto.

Os líderes deste ano compreendem uma coisa: o valor vem da aplicação de dados com objectivos. Escolha o que se adequa à sua estratégia, faça com que funcione em todas as equipas e deixe que os dados se tornem o motor que impulsiona todas as suas acções inteligentes.

Diretor de Big Data e IA

O Philip dá uma atenção especial a tudo o que diz respeito a dados e ao IA. É ele que faz as perguntas certas desde o início, define uma forte visão técnica e garante que não estamos apenas a construir sistemas inteligentes - estamos a construir os sistemas certos, para um verdadeiro valor comercial.

A sua mensagem foi enviada.

Processaremos o seu pedido e contactá-lo-emos logo que possível.

Ao inscrever-se, o utilizador concorda com a nossa Política de privacidadeincluindo a utilização de cookies e a transferência das suas informações pessoais.