Il tuo messaggio è stato inviato.

Elaboreremo la vostra richiesta e vi ricontatteremo al più presto.

Il modulo è stato inviato con successo.

Ulteriori informazioni sono contenute nella vostra casella di posta elettronica.

Selezionare la lingua

Permettetemi di iniziare con un'affermazione audace: 2026 è l'anno della resa dei conti per i grandi industria dei dati. Abbiamo trascorso l'ultimo decennio a sperimentare ogni nuova tecnologia sotto il sole: AI, IoT, piattaforme cloud e tutte queste parole d'ordine. Ma indovinate un po'? È il momento di mettersi in gioco o si perderà la nave. Se la vostra azienda non sta già cercando di capire come trasformare questa massiccia ondata di dati in qualcosa di utilizzabile, sarete lasciati nella polvere.

2026 è il momento di far lavorare questi strumenti per voi e di essere all'avanguardia. Siete curiosi di sapere quali tendenze osservare? Immergiamoci in questa storia.

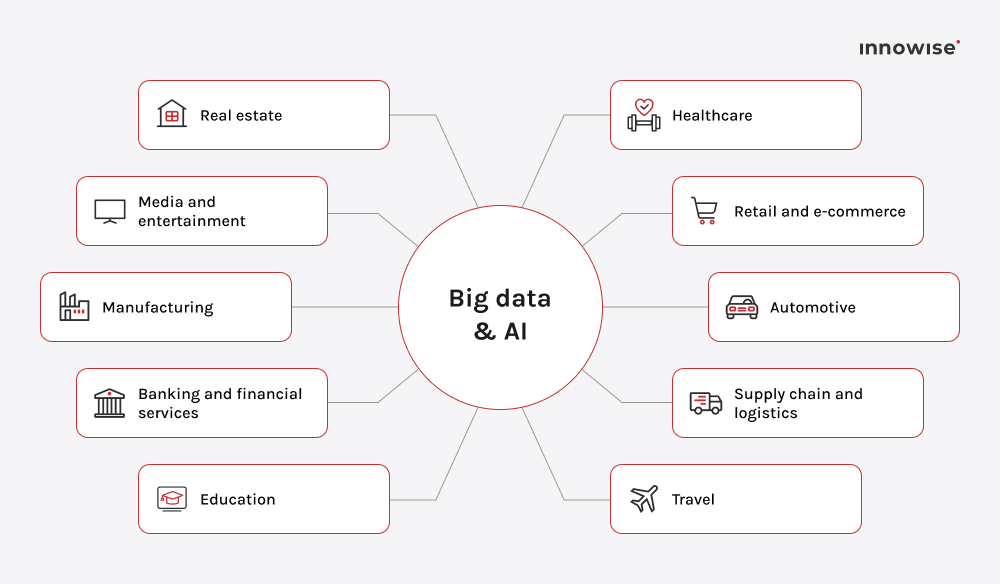

Nel 2026, I big data diventano un fattore chiave per il valore aziendale e si trovano ad avere un impatto su tutti i settori. Dai copiloti analitici guidati da AI all'elaborazione dei bordi in tempo reale, queste tendenze definiscono la futuro dei big data che si sta già svolgendo. Essi determineranno il vostro successo aziendale, quindi leggete questo pezzo fino alla fine.

Uno dei più importanti tendenze future nell'analisi dei big data è l'ascesa di Generative AI. Anche se non è ancora perfetto, GenAI sta già affrontando le parti più lunghe e noiose dell'ingegneria dei dati. L'AI non eliminerà del tutto i problemi di qualità dei dati, ma può ridurre significativamente le ore che il vostro team dedica alla preparazione dei dati.

AI è ora integrato nelle pipeline di dati, in grado di automatizzare operazioni come la pulizia dei dati, il riempimento di lacune mancanti (imputazione) e la trasformazione dei dati. Ciò significa che avrete dati puliti e pronti all'uso in una frazione di tempo. Ad esempio, piattaforme come Databricks e Snowflake includono già funzionalità integrate per pipeline generative abilitate all'AI. Aiuta le organizzazioni ad automatizzare la trasformazione dei dati, il riempimento delle lacune e la consegna di set di dati pronti per AI.

Suggerimento:

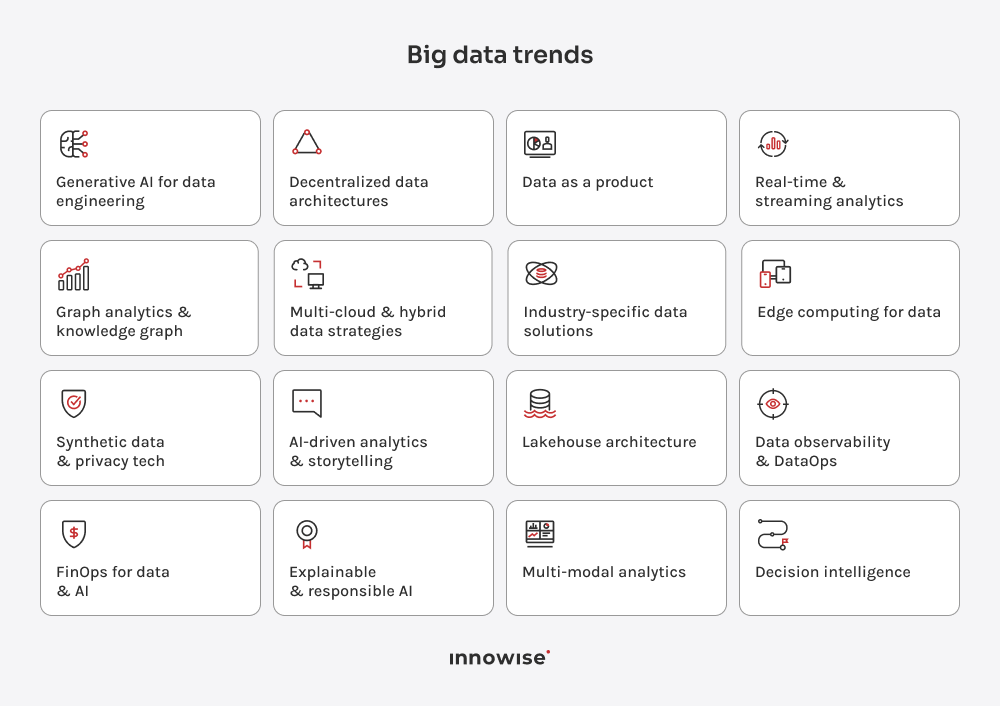

Affidarsi ad architetture di dati obsolete è un ostacolo. La chiave per rimanere competitivi è l'adozione di Data Mesh e Data Fabric.

Data Mesh decentralizza la proprietà dei dati, consentendo ai team di dominio di gestire e servire i propri dati, eliminando il collo di bottiglia della centrale IT. Data Fabric collega tutte le fonti di dati (cloud, on-prem, edge) in un sistema coeso con metadati, lineage e integrazione automatizzati. Insieme, creano un'architettura scalabile e flessibile che consente l'agilità senza sacrificare il controllo.

La crescita del mercato Data Mesh (che dovrebbe raggiungere $5,09 miliardi entro il 2032) mostra la rapidità con cui le aziende si stanno orientando verso modelli di dati decentralizzati.

Suggerimento:

Mentre Data Mesh definisce il architettura per la decentralizzazione, funziona meglio se combinata con una mentalità “data-as-a-product”, in cui ogni set di dati è posseduto, documentato e gestito come un vero e proprio prodotto.

Data Mesh di dati fornisce la struttura. I dati come prodotto danno la disciplina. In 2026, Le aziende intelligenti non si limitano a decentralizzare i dati, ma li gestiscono come un prodotto, con una proprietà chiara, una documentazione e un valore misurabile. Sebbene molte aziende stiano ancora lavorando per centralizzare i propri dati, la tendenza si sta rapidamente allontanando dai dati sepolti in fogli di calcolo casuali o database isolati. In una mentalità che considera i dati come un prodotto, ogni set di dati ha una documentazione, un'assegnazione di ruolo, accordi sul livello di servizio e un ciclo di feedback per il miglioramento.

In questo modo, il marketing sa dove si trovano i dati delle campagne. La finanza si fida dei numeri delle entrate senza bisogno di una “giornata di riconciliazione dei dati”. E l'ingegneria smette finalmente di fare da collo di bottiglia tra i dashboard di tutti gli altri.

Piattaforme come Snowflake Data Cloud e Mercato Databricks aiutano già i team a pubblicare, condividere e persino monetizzare i prodotti di dati internamente o con i partner. Questo apre nuove porte alla collaborazione e a nuovi flussi di reddito. Soprattutto quando il vostro “prodotto di dati” diventa qualcosa che altri vogliono acquistare o su cui costruire.

Suggerimento:

“Noi di Innowise ci assicuriamo sempre che i dati lavorino per voi in modo pratico ed efficiente. Il nostro approccio integra AI, automatizza i flussi di lavoro dei dati e consente di ottenere informazioni in tempo reale, in modo che il team non sia impantanato dalla complessità. Ottenete dati puliti e fruibili quando ne avete bisogno, in modo da poter prendere decisioni basate sui fatti.."

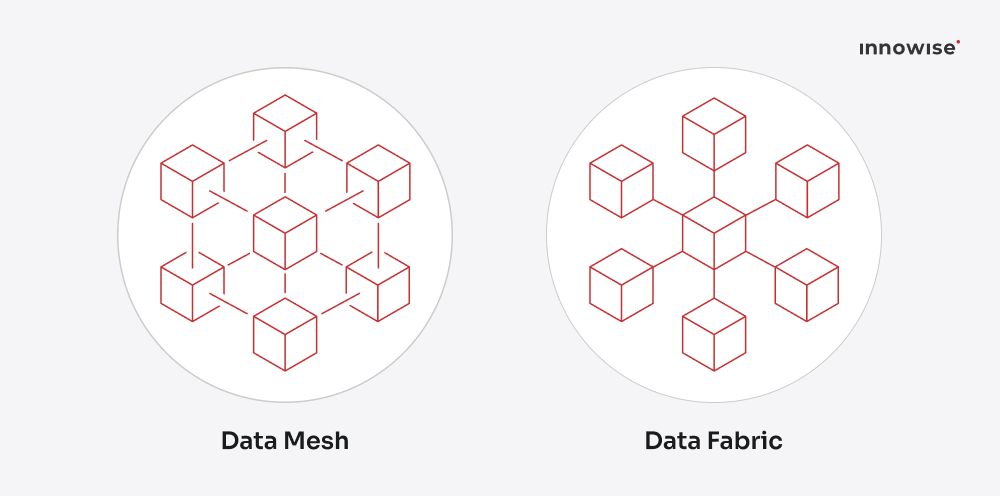

Il prossimo della lista di le tendenze future dei big data è analisi in tempo reale. Sebbene il concetto sia in fase di sviluppo da anni, entro il 2026 si trasformerà rapidamente da un vantaggio competitivo a necessità fondamentale. necessità di base per le organizzazioni che richiedono approfondimenti immediati. Elaborando i dati nel momento stesso in cui arrivano, invece di aspettare i lotti, si sblocca la capacità di agire su eventi, segnali e modelli. come si verificano. Per l'arena dei big data, questo significa streaming di fonti di dati ad alto volume (sensori IoT, interazioni degli utenti, registri) attraverso pipeline che analizzano e rispondono in pochi secondi o millisecondi.

Il mercato sostiene questo cambiamento. Il settore globale dell'analisi dello streaming è stato valutato pari a $23,4 miliardi nel 2023 e si prevede una crescita fino a circa $ 128,4 miliardi entro il 2030, con un CAGR di circa 28,3% tra il 2024 e il 2030. Settori come la finanza, le telecomunicazioni, la produzione e la vendita al dettaglio stanno già utilizzando modelli basati sui flussi per il rilevamento delle frodi, la determinazione dinamica dei prezzi, la manutenzione predittiva e l'ottimizzazione dell'esperienza del cliente.

Suggerimento:

Se la vostra strategia sui dati considera ancora il tempo reale come un “extra” e si concentra in primo luogo sui batch, 2026 evidenzierà il divario, credetemi.

L'analisi dei grafici è al centro dell'attenzione nel 2026, non come nuova tecnologia, ma perché la sua adozione viene rapidamente accelerata dall'integrazione AI. Invece di trattare i dati solo come righe e colonne, le organizzazioni utilizzano i grafici per capire come le entità si connettono: clienti, prodotti, nodi di sensori, anelli di frode e così via. Grafici della conoscenza e database a grafo rendono possibile tutto questo: mappano relazioni complesse e mettono in luce intuizioni che i metodi tradizionali faticano a rivelare. Ad esempio, un Il recente rapporto sul database dei grafici di Verified Market Reports spiega che che i database a grafo sono ora fondamentali per l'elaborazione in tempo reale, le relazioni semantiche e il rilevamento delle anomalie guidato da AI.

Per i dirigenti d'azienda, il vantaggio principale è il seguente: si scoprono perché le cose accadono, non solo che che si verificano. Nel rilevamento delle frodi, si individua la rete di attori; nella raccomandazione, si mappano le affinità nascoste; nell'IoT, si tracciano le catene di guasti. Questo potere porta approfondimento, rilevamento più rapido, e un'azione più strategica.

Suggerimento:

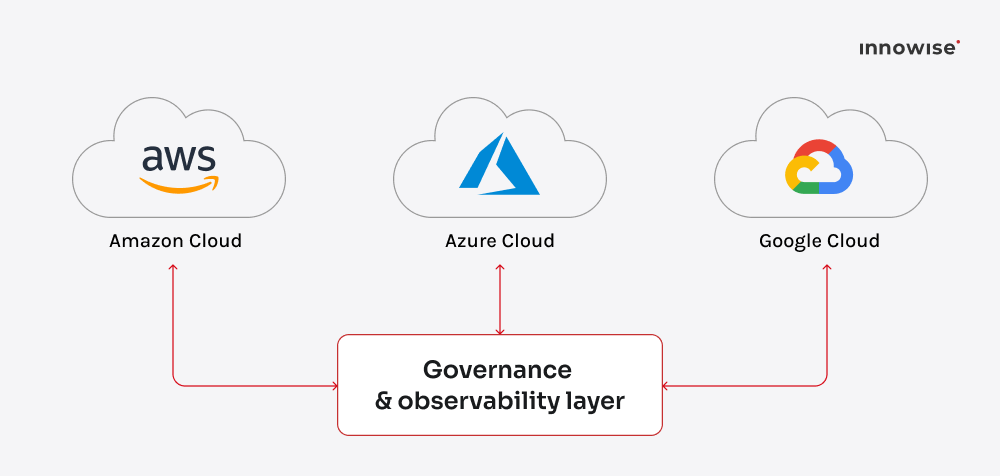

Nel 2026, affidarsi esclusivamente a un unico fornitore di cloud è sempre più considerato un rischio, un po' come puntare tutti gli investimenti su un'unica azione. Sebbene molte organizzazioni utilizzino ancora principalmente una sola piattaforma, le aziende strategicamente più avanzate giocano ora la partita del multi-cloud. Bilanciano i servizi di AWS, Azure e Google Cloud per evitare il lock-in e ottenere il miglior rapporto prestazioni/costi da ciascuno di essi.

Anche le configurazioni ibride sono in aumento. In questo caso, le organizzazioni combinano i servizi cloud con i loro data center on-premises. Le ragioni di questo approccio ibrido sono più profonde del semplice mantenimento dei dati sensibili in sede:

La fregatura? La complessità. La distribuzione dei carichi di lavoro tra i vari cloud introduce più parti mobili: API diverse, sistemi di fatturazione e regole di governance. I vincitori sono coloro che automatizzano il livello di orchestrazione e monitoraggio. Pensate ai motori di interrogazione cross-cloud, alla gestione unificata delle identità e agli strumenti di osservabilità che tracciano latenza e costi in tempo reale.

Suggerimento:

Le piattaforme di dati generiche sono ottime. Finché non iniziano a non risolvere nulla di particolare. Ecco perché, in 2026, Le aziende che operano in settori supercompetitivi, ad alto rischio o regolamentati non hanno più bisogno di strumenti generici. Vogliono soluzioni personalizzate per il settore, che parlino la loro lingua, gestiscano le loro normative e diano risultati, invece di dashboard che sembrano impressionanti ma significano poco.

Allora, perché le aziende richiedono improvvisamente queste soluzioni specializzate in 2026? Il tutto si riduce a tre grandi cose:

I team sanitari vogliono l'analisi predittiva che aiutano i medici a individuare i rischi dei pazienti prima che si aggravino. Le banche si preoccupano di individuare le frodi, risk scoring e offerte iper-personalizzate. I produttori tengono traccia della salute delle apparecchiature e della visibilità della catena di fornitura fino al minuto. E I retailer stanno mescolando i dati delle transazioni con i sensori del negozio e le tendenze sociali per prevedere la domanda senza dover guardare i fogli di calcolo.

Per questo motivo il mercato si sta orientando verso prodotti di dati specifici per il dominio: modelli, connettori e framework di conformità precostituiti che si inseriscono direttamente nei flussi di lavoro reali. Questa specializzazione sta già dimostrando una crescita massiccia nei mercati verticali. Per esempio, secondo Visiongain, il mercato dell'analisi sanitaria da solo raggiungerà $101 miliardi entro il 2031, guidato da questo tipo di specializzazione.

Suggerimento:

Nel 2026, La richiesta di un'azione immediata e automatizzata è fondamentale. Sebbene il cloud sia ancora fondamentale, le aziende si stanno rendendo conto che l'invio di informazioni costa troppo in termini di tempo e denaro. ogni singolo byte di dati a un server distante per l'elaborazione.

L'edge computing è la soluzione. Porta l'elaborazione dei dati più vicino al luogo in cui vengono generati: sensori, macchine, dispositivi, persino automobili. Invece di inviare terabyte attraverso la rete, si elaborano i dati importanti a livello locale e si agisce istantaneamente.

Perché questa tendenza sta esplodendo ora?

Questo è importante soprattutto per i settori in cui la velocità è la vita: fabbriche intelligenti che regolano le linee di produzione al volo, ospedali che monitorano i pazienti in tempo reale o catene di vendita al dettaglio che gestiscono i prezzi in modo dinamico in base alla domanda locale. E il denaro lo sostiene: Previsioni IDC la spesa globale per le soluzioni di edge computing crescerà ad un CAGR di ~13,8% e raggiungerà quasi $380 miliardi entro il 2028.

Le organizzazioni più intelligenti non stanno sostituendo il cloud, ma lo stanno completando. Utilizzano una configurazione ibrida: elaborazione locale per la velocità, archiviazione nel cloud per la scala. Il risultato è splendido: latenza più bassa, costi di banda ridotti e decisioni più rapide che spostano effettivamente l'ago della bilancia.

Suggerimento:

Nel 2026, L'accesso ai dati del mondo reale è più difficile che mai: le leggi sulla privacy sono più severe, le autorità di regolamentazione sono attente e gli utenti sono molto meno indulgenti. Ecco perché abbiamo bisogno di dati sintetici.

La tendenza sta esplodendo ora perché il Braccio GenAI ha finalmente reso i dati sintetici di qualità sufficientemente elevata da imitare in modo affidabile le informazioni complesse del mondo reale. Le aziende si affidano sempre più a questi dati artificiali e statisticamente accurati per addestrare modelli AI massivi in modo più rapido ed economico rispetto ai metodi tradizionali, soddisfacendo automaticamente le esigenze di conformità più severe, come il GDPR e la legge AI dell'UE.

Gli strumenti per i dati sintetici sono ovunque: dalle società finanziarie che addestrano i modelli di rilevamento delle frodi alle aziende sanitarie che eseguono diagnosi AI senza esporre i dati dei pazienti. Gartner prevede che entro il 2030, i dati sintetici supereranno i dati reali nella formazione AI, perché è più sicuro, più veloce e più facile da scalare.

Suggerimento:

Nel 2026, L'analisi è finalmente umana. I copiloti AI e gli strumenti di visualizzazione narrativa ora trasformano i dati in storie chiare invece che in grafici infiniti. Strumenti come Power BI Copilot, Tableau GPT, cammelloAI, e il livello GenAI di Looker è in grado di interrogare, riassumere e spiegare le informazioni in un linguaggio semplice.

Pensate a loro come al vostro analista di dati. Potete chiedere: “Qual è stato l'andamento dei ricavi in questo trimestre?” o “Quale campagna ha portato il ROI più alto?” e ottenere risposte immediate in un linguaggio semplice. Strumenti come Power BI Copilota, Tableau GPT, e cammelloAI Lo fanno già, collegando modelli linguistici di grandi dimensioni direttamente ai dati della vostra azienda.

Suggerimento:

Nel 2026, La linea di demarcazione tra data lake e warehouse è sfumata. Il nuovo standard è lakehouse architecture, un modello ibrido che combina la scalabilità dei laghi di dati con la struttura e le prestazioni dei magazzini. È possibile archiviare dati non strutturati, interrogarli con SQL ed eseguire carichi di lavoro di apprendimento automatico. Tutto in un unico luogo. Senza doversi destreggiare tra dieci piattaforme diverse.

Fornitori come Databricks, Snowflake, e Google BigQuery stanno guidando la carica qui.

Suggerimento:

Nel 2026, Gestire pipeline di dati senza osservabilità è come pilotare un aereo con il cruscotto spento. Ci si può muovere velocemente, ma non si ha idea di cosa si stia rompendo. L'osservabilità dei dati è il modo in cui i team ottengono visibilità sulla salute, la freschezza e l'affidabilità dei loro dati. Ci dice quando qualcosa non va, perché è successo e come risolverlo prima che i dashboard inizino a mostrare cose senza senso.

Perché è essenziale ora? Perché non è possibile avere una governance o una compliance senza di essa.

Questo va di pari passo con DataOps, che automatizza operazioni come i test e la distribuzione. Insieme, l'osservabilità e DataOps offrono una struttura di dati affidabile, conforme e solida, con meno sorprese e tempi di ripristino più rapidi.

Suggerimento:

Le bollette del cloud vi hanno mai tenuto svegli la notte? Con l'esplosione dei volumi di dati e la moltiplicazione dei carichi di lavoro AI, FinOps (operazioni finanziarie per il cloud e i dati) diventa essenziale. L'obiettivo è semplice: capire dove va a finire ogni dollaro del vostro ecosistema di dati e assicurarsi che stia effettivamente acquistando valore aziendale, non solo server più grandi.

La formazione di modelli di grandi dimensioni, l'archiviazione di petabyte di dati e l'esecuzione di query infinite possono prosciugare rapidamente i budget. I team FinOps utilizzano ora l'analisi e l'automazione per tracciare i costi in tempo reale, individuare le inefficienze e prevedere l'utilizzo nei vari reparti. I fornitori Cloud offrono persino strumenti nativi per questo (AWS Cost Explorer, Google Cloud Billing, Azure Cost Management), ma i veri vantaggi derivano dall'integrazione delle metriche finanziarie direttamente nei flussi di lavoro dei dati.

Suggerimento:

Nel 2026, L'AI gestisce così tante attività che “fidarsi del modello” non funziona più. I consigli di amministrazione, le autorità di regolamentazione e i clienti si aspettano tutti che trasparenza. Vogliono sapere perché un algoritmo ha preso una decisione, non solo il risultato. Ecco perché Spiegabile AI (XAI) e Responsabile AI stanno guadagnando terreno. Insieme, rendono l'apprendimento automatico meno una scatola nera e più un sistema che si può governare.

Le banche utilizzano già modelli spiegabili per giustificare le decisioni di credito ai revisori. Gli operatori sanitari si affidano a loro per mostrare come gli algoritmi diagnostici giungono alle conclusioni. Anche i sistemi HR sono sotto esame per dimostrare l'equità delle raccomandazioni di assunzione. Quando le decisioni riguardano le persone o i profitti, la fiducia cieca in AI non è una strategia, ma un rischio.

Suggerimento:

Entro il 2026, sviluppo di big data si sposterà oltre le tabelle e i cruscotti per entrare in una nuova era di analisi multimodale. Qui, testo, immagini, video e dati dei sensori si combinano per creare un quadro completo e ricco di contesto. Invece di analizzare separatamente i feedback dei clienti e i numeri delle vendite, i team possono ora correlare le trascrizioni delle chiamate, le foto dei prodotti e il comportamento degli utenti in un unico spazio di lavoro.

Sembra fantascienza, vero? Ma piattaforme come Databricks MosaicML, Claude antropica per i dati, e GPT-4 Turbo con visione di OpenAI gestiscono già input di dati multiformato. Il risultato è fantastico. Le intuizioni ricche di contesto sembrano quasi intuitive. Immaginate di prevedere i guasti delle apparecchiature analizzando in modo incrociato i registri delle vibrazioni, le immagini termiche e le note di manutenzione. Ecco cosa permette l'analisi multimodale.

Suggerimento:

E l'ultimo della lista di tendenze chiave dei big data è intelligenza decisionale (DI). Essa fonde la scienza dei dati, psicologia e logica aziendale per aiutare le organizzazioni a prendere decisioni più intelligenti e più rapidamente. Invece di proporre un centinaio di metriche, i sistemi DI modellano il modo in cui le scelte portano ai risultati, quindi simulano gli scenari prima di impegnarsi.

Consideratela come un'analisi che risponde “Cosa succede se lo facciamo davvero?”.”, non solo “Cosa è successo nell'ultimo trimestre?” I rivenditori lo usano per testare le strategie di prezzo prima del lancio. Le banche lo usano per simulare l'esposizione al rischio dei portafogli. Anche i team delle risorse umane usano l'AI per prevedere l'impatto delle assunzioni e della fidelizzazione prima che le politiche entrino in vigore.

Il mercato evidenzia questo cambiamento: il mercato globale della decision intelligence è stato stimato in $15,22 miliardi nel 2024 e si prevede che raggiungerà $36,34 miliardi entro il 2030, con una crescita di circa 15,4% CAGR.

Suggerimento:

Qual è dunque il futuro dei big data? 2026 porta un nuovo livello di maturità. L'attenzione si concentra ora sulla scelta degli strumenti e dei metodi che creano effettivamente un impatto. Le aziende che collegano la tecnologia a obiettivi chiari vedranno una crescita più rapida e risultati più solidi.

Utilizzate AI per risparmiare tempo e migliorare l'accuratezza. Create una Data Mesh che aiuti i team a lavorare insieme invece che in silos. Investite in analisi in tempo reale che vi aiutino ad agire al momento giusto, non dopo i fatti.

I leader di quest'anno hanno capito una cosa: il valore deriva dall'applicazione mirata dei dati. Scegliete ciò che si adatta alla vostra strategia, fatelo funzionare tra i vari team e lasciate che i dati diventino il motore di ogni vostra mossa intelligente.

Responsabile Big Data e AI

Philip mette a fuoco tutto ciò che riguarda i dati e AI. È lui che pone le domande giuste in anticipo, definisce una visione tecnica forte e si assicura che non stiamo solo costruendo sistemi intelligenti, ma che stiamo costruendo quelli giusti, per un reale valore aziendale.

Il tuo messaggio è stato inviato.

Elaboreremo la vostra richiesta e vi ricontatteremo al più presto.

Iscrivendosi si accetta il nostro Informativa sulla privacy, compreso l'uso dei cookie e il trasferimento dei vostri dati personali.