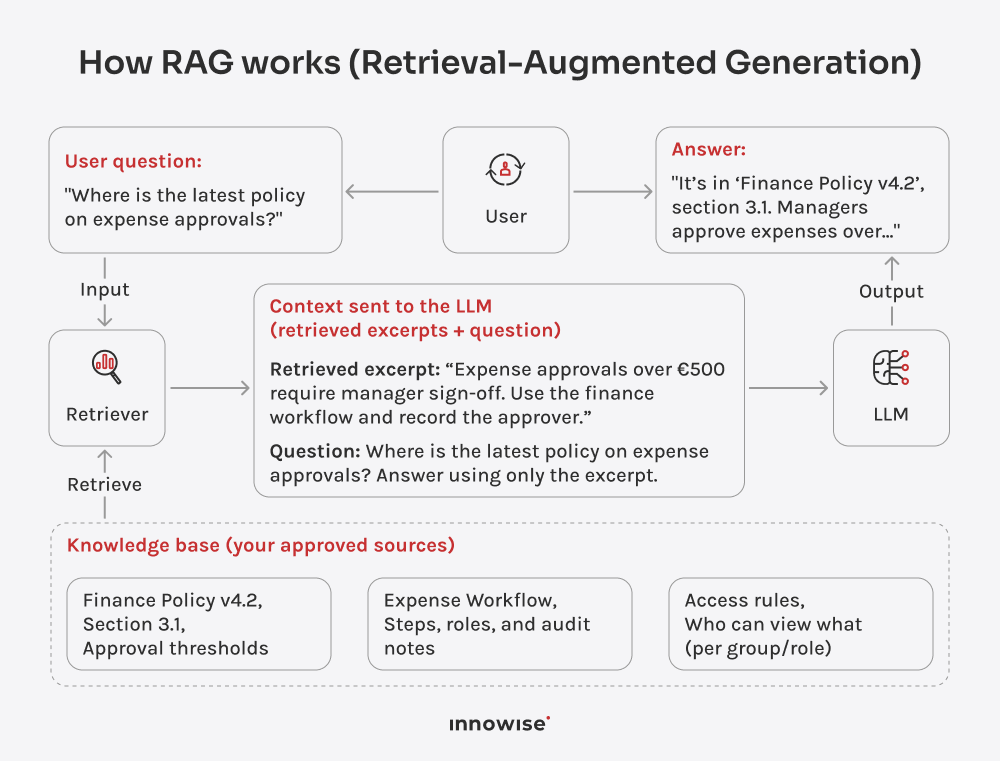

Dabei können interne Dokumente, Knowledge-Base-Artikel, Wiki-Seiten, Support-Inhalte und andere von Ihnen genehmigte Textquellen verwendet werden. Das Wichtigste ist, dass Sie die Quellen und die Zugriffsregeln kontrollieren.

Ihre Nachricht wurde gesendet.

Wir werden Ihre Anfrage bearbeiten und uns so schnell wie möglich mit Ihnen in Verbindung setzen.