Meldingen din er sendt.

Vi behandler forespørselen din og kontakter deg så snart som mulig.

Skjemaet har blitt sendt inn.

Mer informasjon finner du i postkassen din.

La meg starte med en dristig uttalelse: 2026 r sannhetens år for big data-industrien dataindustrien. Vi har brukt det siste tiåret på å eksperimentere med all verdens skinnende ny teknologi: AI, IoT, skyplattformer og alle de andre moteordene. Men vet du hva? Det er på tide å stille opp, ellers går du glipp av båten. Hvis bedriften din ikke allerede er i gang med å finne ut hvordan du kan gjøre den enorme mengden data om til noe brukbart, kommer du til å bli akterutseilt.

2026 er tiden inne for å få disse verktøyene til å fungere for deg og ligge i forkant av utviklingen. Er du nysgjerrig på hvilke trender du bør holde øye med? La oss dykke ned i det.

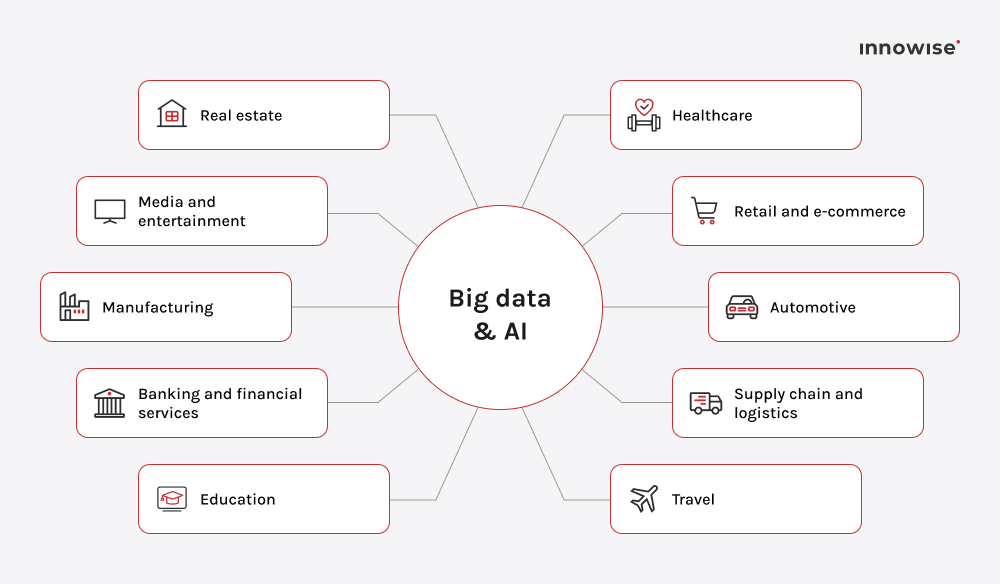

I 2026, I takt med at stordata blir en viktig drivkraft for forretningsverdi, vil du se at det påvirker alle bransjer der ute. Fra AI-drevne analytiske copiloter til sanntids edge-prosessering - disse trendene definerer fremtiden for stordata som allerede er i ferd med å utfolde seg. De vil forme din forretningssuksess, så les denne artikkelen til siste slutt.

En av de mest virkningsfulle fremtidige trender innen stordataanalyse er fremveksten av Generative AI. Selv om det ikke er perfekt ennå, tar GenAI allerede tak i de mest tidkrevende og kjedelige delene av datateknikk. AI vil ikke eliminere datakvalitetsutfordringene helt, men det kan redusere antall timer teamet ditt bruker på å klargjøre data betydelig.

AI integreres nå i datapipelines, og kan automatisere oppgaver som datarensing, fylling av manglende hull (imputering) og datatransformering. Dette betyr at du får rene, bruksklare data på en brøkdel av tiden. For eksempel kan plattformer som Databricks og Snowflake inkluderer allerede innebygd funksjonalitet for generative-AI-aktiverte pipelines. Det hjelper organisasjoner med å automatisere datatransformasjon, gap-fylling og levering av AI-klare datasett.

Profftips:

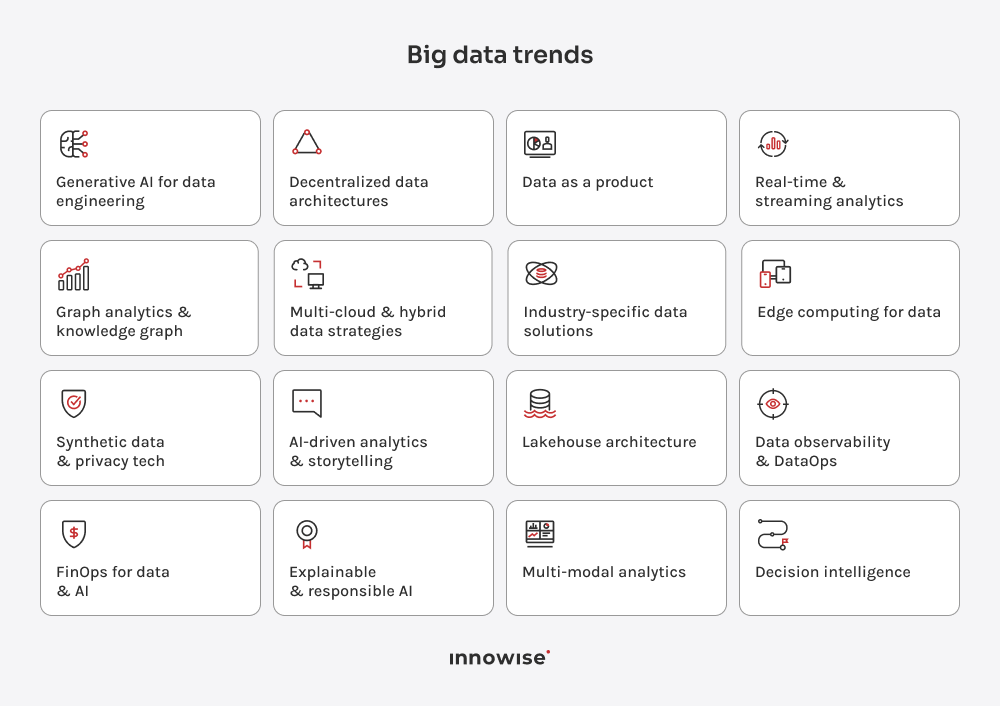

Å basere seg på utdaterte dataarkitekturer vil holde deg tilbake. Nøkkelen til å holde seg konkurransedyktig er å ta i bruk Data Mesh og Data Fabric.

Data Mesh desentraliserer dataeierskapet, slik at domeneteamene kan administrere og betjene sine egne data, og dermed slippe flaskehalsen med sentrale IT. Data Fabric kobler sammen alle datakilder (skyen, lokalt, edge) til et sammenhengende system med automatiserte metadata, lineage og integrasjon. Sammen skaper de en skalerbar, fleksibel arkitektur som gir smidighet uten at det går på bekostning av kontroll.

Veksten i Data Mesh-markedet (anslått til å nå $5,09 milliarder innen 2032) viser hvor raskt virksomheter går over til desentraliserte datamodeller.

Profftips:

Mens Data Mesh definerer arkitektur for desentralisering, fungerer det best når det kombineres med en “data-som-produkt”-tankegang, der hvert datasett eies, dokumenteres og forvaltes som et ekte produkt.

Data Mesh gir deg strukturen. Data som et produkt gir deg disiplin. I 2026, Smarte selskaper desentraliserer ikke bare data, de håndterer dem også som et produkt, med tydelig eierskap, dokumentasjon og målbar verdi. Selv om mange selskaper fortsatt jobber med å sentralisere dataene sine, går trenden raskt bort fra data som ligger begravd i tilfeldige regneark eller isolerte databaser. I en data-som-produkt-tankegang har hvert datasett dokumentasjon, rolletildeling, servicenivåavtaler og en tilbakemeldingssløyfe for forbedring.

På denne måten vet markedsavdelingen hvor kampanjedataene deres befinner seg. Økonomifunksjonen stoler på inntektstallene uten å trenge en “dataavstemmingsdag”. Og ingeniørene slipper endelig å fungere som flaskehalsen mellom alle de andres dashbord.

Plattformer som Snowflake Data Cloud og Databricks Marketplace hjelper allerede team med å publisere, dele og til og med tjene penger på dataprodukter internt eller med partnere. Det åpner nye dører for samarbeid og nye inntektsstrømmer. Spesielt når “dataproduktet” ditt blir noe andre ønsker å kjøpe eller bygge videre på.

Profftips:

"Hos Innowise sørger vi alltid for at data fungerer for deg på en praktisk og effektiv måte. Vår tilnærming integrerer AI, automatiserer dataarbeidsflyter og muliggjør innsikt i sanntid, slik at teamet ditt ikke blir overveldet av kompleksitet. Du får rene, handlingsrettede data når du trenger dem, slik at du kan ta beslutninger basert på fakta."

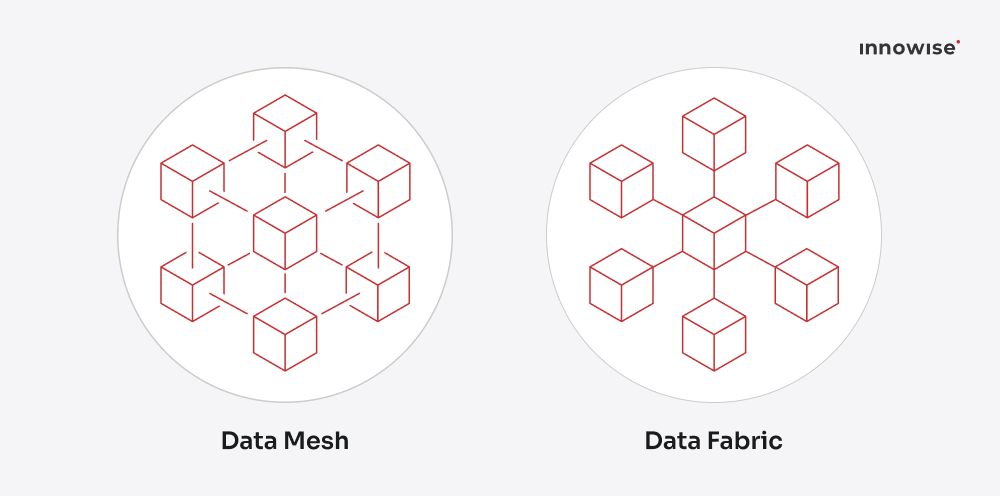

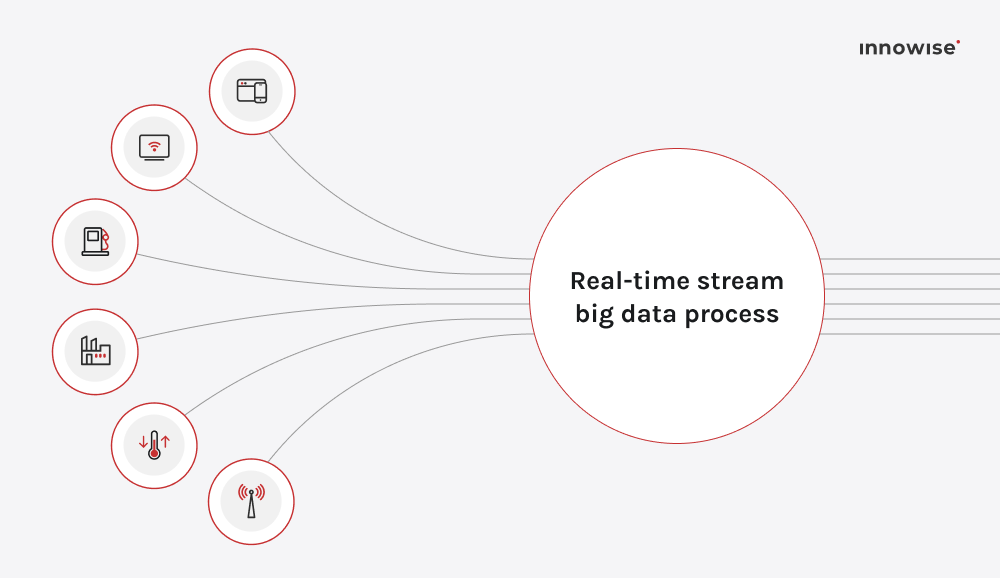

Den neste på listen over fremtidige trender innen stordata er sanntidsanalyse. Konseptet har vært under utvikling i mange år, men innen 2026 vil det raskt ha utviklet seg fra å være et konkurransefortrinn til å bli et grunnleggende nødvendighet for organisasjoner som krever øyeblikkelig innsikt. Når du behandler data i det øyeblikket de kommer inn, i stedet for å vente på batcher, får du muligheten til å handle på hendelser, signaler og mønstre. når de skjer. For stordata-arenaen betyr dette strømming av datakilder med store volumer (IoT-sensorer, brukerinteraksjoner, logger) gjennom pipelines som analyserer og reagerer i løpet av sekunder eller millisekunder.

Markedet støtter dette skiftet. Den globale sektoren for strømmeanalyse ble verdsatt til $23,4 milliarder i 2023 og forventes å vokse til rundt $ 128,4 milliarder innen 2030, med en CAGR på omtrent 28,3% mellom 2024 og 2030. Bransjer som finans, telekom, produksjon og detaljhandel bruker allerede strømbaserte modeller til å oppdage svindel, dynamisk prising, prediktivt vedlikehold og optimalisering av kundeopplevelsen.

Profftips:

Hvis datastrategien din fortsatt behandler sanntid som noe “ekstra” og fokuserer sterkt på batch først, 2026 vil fremheve gapet, tro meg.

Grafanalyse kommer i søkelyset i 2026, ikke som en ny teknologi, men fordi integrasjonen med AI akselererer innføringen av den. I stedet for å behandle data utelukkende som rader og kolonner, bruker organisasjoner grafer for å forstå hvordan enheter kobles sammen: kunder, produkter, sensornoder, svindelringer og så videre. Kunnskapsgrafer og grafdatabaser gjør dette mulig: De kartlegger komplekse sammenhenger og avdekker innsikter som tradisjonelle metoder sliter med å få frem. For eksempel kan en fersk grafdatabaserapport fra Verified Market Reports forklarer at grafdatabaser nå er avgjørende for sanntidsbehandling, semantiske relasjoner og AI-drevet anomalideteksjon.

For bedriftsledere er den viktigste fordelen denne: Du avdekker hvorfor ting skjer, ikke bare at de skjer. Når det gjelder svindeloppdagelse, oppdager du nettverket av aktører, når det gjelder anbefalinger, kartlegger du skjulte forbindelser, og når det gjelder IoT, sporer du kjeder av feil. Denne kraften gir dypere innsikt, raskere deteksjon, og mer strategisk handling.

Profftips:

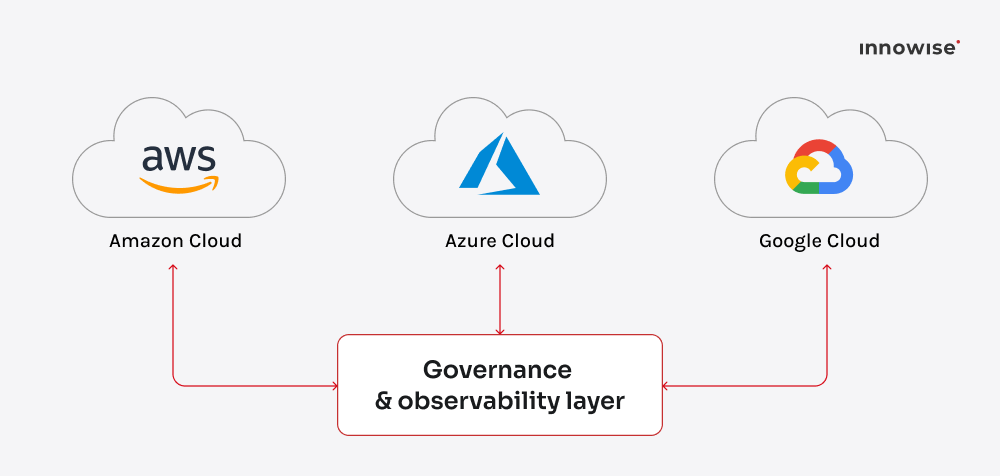

I 2026 blir det i økende grad sett på som en risiko å stole utelukkende på én enkelt skyleverandør, på samme måte som å plassere alle investeringene i én enkelt aksje. Selv om mange organisasjoner fortsatt primært bruker én plattform, spiller de mest strategisk avanserte selskapene nå multisky-spillet. De balanserer tjenester fra AWS, Azure og Google Cloud for å unngå innlåsing og få det beste forholdet mellom ytelse og kostnad ut av hver av dem.

Hybride oppsett øker også. Her kombinerer organisasjoner skytjenester med sine eksisterende lokale datasentre. Årsakene til denne hybride tilnærmingen går dypere enn bare å beholde sensitive data lokalt:

Haken? Kompleksitet. Spredning av arbeidsbelastninger på tvers av skyer introduserer flere bevegelige deler: forskjellige API-er, faktureringssystemer og styringsregler. Vinnerne er de som automatiserer orkestrerings- og overvåkingslaget. Tenk spørringsmotorer på tvers av skyer, enhetlig identitetsadministrasjon og observasjonsverktøy som sporer ventetid og kostnader i sanntid.

Profftips:

Generiske dataplattformer er flotte. Helt til de begynner å løse noe spesielt. Dette er grunnen til at vi i 2026, I dag er selskaper i konkurranseutsatte, risikoutsatte eller regulerte bransjer ferdige med generiske verktøy. De vil ha bransjetilpassede løsninger som snakker deres språk, håndterer deres regelverk og leverer resultater i stedet for instrumentpaneler som ser imponerende ut, men som betyr lite.

Så hvorfor etterspør bedriftene plutselig disse spesialiserte løsningene i 2026? Det koker egentlig ned til tre store ting:

Helsepersonell ønsker prediktive analyser som hjelper legene med å oppdage pasientrisikoer før de eskalerer. Bankene er opptatt av å oppdage svindel, risikoscoring og hyperpersonaliserte tilbud. Produsenter sporer utstyrets tilstand og har oversikt over forsyningskjeden ned til minutt. Og forhandlere blander transaksjonsdata med sensorer i butikkene og sosiale trender for å forutsi etterspørselen uten å stirre inn i regneark.

Det er derfor markedet beveger seg mot domenespesifikke dataprodukter: forhåndsbygde modeller, koblinger og compliance-rammeverk som passer rett inn i reelle arbeidsflyter. Denne spesialiseringen viser allerede massiv vekst i vertikale markeder. Ifølge Visiongain er for eksempel markedet for helseanalyse alene vil nå $101 milliarder kroner innen 2031, drevet av denne typen spesialisering.

Profftips:

I 2026, er kravet om umiddelbar, automatisert handling avgjørende. Selv om skyen fortsatt er viktig, innser bedriftene at det koster for mye tid og penger å sende hver eneste byte av data til en ekstern server for behandling.

Edge computing er løsningen. Det bringer databehandlingen nærmere der den genereres: sensorer, maskiner, enheter og til og med biler. I stedet for å sende terabyte med data over nettverket, kan du behandle de viktige dataene lokalt og handle umiddelbart.

Hvorfor eksploderer denne trenden nå?

Dette er viktigst for bransjer der hastighet er livsviktig: smarte fabrikker som justerer produksjonslinjene underveis, sykehus som overvåker pasienter i sanntid, eller butikkjeder som styrer prisene dynamisk basert på lokal etterspørsel. Og det er penger i det: IDCs prognoser globale utgiftene til edge computing-løsninger vil vokse med ~13,8% CAGR og nå nesten $380 milliarder innen 2028.

De smarteste organisasjonene erstatter ikke skyen, de kompletterer den. De bruker et hybridoppsett: lokal prosessering for hastighet, skylagring for skala. Resultatet er fantastisk: lavere ventetid, reduserte båndbreddekostnader og raskere beslutninger som faktisk flytter nålen.

Profftips:

I 2026, Det er vanskeligere enn noensinne å få tilgang til data fra den virkelige verden: Personvernlovene er strengere, tilsynsmyndighetene er på vakt, og brukerne er langt mindre tilgivende. Derfor trenger vi syntetiske data.

Trenden eksploderer nå fordi GenAI bom har endelig gjort syntetiske data av høy nok kvalitet til å etterligne kompleks informasjon fra den virkelige verden på en pålitelig måte. Bedrifter er i økende grad avhengige av disse kunstige, statistisk nøyaktige dataene for å trene opp massive AI-modeller raskere og billigere enn med tradisjonelle metoder, samtidig som de automatisk oppfyller strenge krav til etterlevelse av GDPR og EUs AI-lov.

Syntetiske dataverktøy finnes overalt: fra finansfirmaer som trener opp modeller for å oppdage svindel, til helseforetak som kjører AI-diagnostikk uten å eksponere pasientdata. Gartner forventer at det innen 2030, syntetiske data vil overgå reelle data i AI-opplæringen, fordi det er tryggere, raskere og enklere å skalere.

Profftips:

I 2026, Endelig føles analyse menneskelig. AI copiloter og narrative visualiseringsverktøy gjør nå data om til tydelige historier i stedet for endeløse diagrammer. Verktøy som Power BI Copilot, Tableau GPT, camelAI, og Lookers GenAI-lag kan spørre, oppsummere og forklare innsikt på et enkelt språk.

Tenk på dem som dataanalytikeren din. Du kan spørre: “Hvordan utviklet omsetningen seg dette kvartalet?” eller “Hvilken kampanje ga høyest avkastning på investeringen?” og få umiddelbare svar i klartekst. Verktøy som Power BI Copilot, Tableau GPT, og kamelAI allerede gjør dette, og kobler store språkmodeller direkte til bedriftens data.

Profftips:

I 2026, har grensen mellom datasjøer og datavarehus blitt visket ut. Den nye standarden er lakehouse architecture, som er en hybridmodell som kombinerer skalerbarheten til datasjøer med strukturen og ytelsen til datavarehus. Du kan lagre ustrukturerte data, søke i dem med SQL og kjøre maskinlæring. Alt på ett sted. Uten å sjonglere med ti forskjellige plattformer.

Leverandører som Databricks, Snowflake, og Google BigQuery er de som leder an her.

Profftips:

I 2026, Å administrere datapipelines uten observerbarhet er som å fly et fly med dashbordet slått av. Du beveger deg kanskje raskt, men du har ingen anelse om hva som går i stykker. Dataobservabilitet er hvordan teamene får innsyn i dataenes tilstand, friskhet og pålitelighet. Det forteller deg når noe er galt, hvorfor det skjedde, og hvordan du kan fikse det før dashbordene begynner å vise tull og tøys.

Så hvorfor er dette viktig nå? Fordi du ikke kan ha styring eller etterlevelse uten det.

Dette går hånd i hånd med DataOps, som automatiserer ting som testing og distribusjon. Sammen gir observabilitet og DataOps deg en pålitelig, kompatibel og bunnsolid datagrunnmur med færre overraskelser og raskere gjenopprettingstid.

Profftips:

Har du noen gang ligget våken om natten på grunn av skyregninger? Etter hvert som datamengdene eksploderer og AI-arbeidsbelastningen mangedobles, FinOps (økonomiske operasjoner for sky og data) blir avgjørende. Målet er enkelt: forstå hvor hver eneste krone i dataøkosystemet ditt går, og sørg for at den faktisk går til å kjøpe forretningsverdi, ikke bare større servere.

Opplæring av store modeller, lagring av petabytes med data og kjøring av endeløse spørringer kan fort tære på budsjettene. FinOps-team bruker nå analyse og automatisering til å spore kostnader i sanntid, oppdage ineffektivitet og forutsi bruk på tvers av avdelinger. Cloud-leverandører tilbyr til og med egne verktøy for dette (AWS Cost Explorer, Google Cloud Billing, Azure Cost Management), men den virkelige gevinsten kommer ved å integrere økonomiske beregninger direkte i dataarbeidsflytene dine.

Profftips:

I 2026, AI styrer så mye av virksomheten at “bare stol på modellen” ikke holder lenger. Styrer, tilsynsmyndigheter og kunder forventer alle åpenhet. De ønsker å vite hvorfor en algoritme tok en beslutning, ikke bare resultatet. Det er derfor Explainable AI (XAI) og Ansvarlig AI får stadig større gjennomslagskraft. Sammen gjør de maskinlæring til en mindre svart boks og mer til et system du kan styre.

Bankene bruker allerede forklaringsmodeller for å begrunne kredittbeslutninger overfor revisorer. Helsepersonell er avhengige av dem for å vise hvordan diagnostiske algoritmer kommer frem til konklusjoner. Til og med HR-systemer er under lupen for å bevise at ansettelsesanbefalinger er rettferdige. Når beslutninger påvirker mennesker eller fortjeneste, er blind tillit til AI ikke en strategi, det er en risiko.

Profftips:

Innen 2026, utvikling av stordata vil gå fra tabeller og dashbord til en ny æra med multimodale analyser. Her kombineres tekst, bilder, video og sensordata for å skape et komplett, kontekstrikt bilde. I stedet for å analysere tilbakemeldinger fra kunder og salgstall hver for seg, kan teamene nå korrelere transkripsjoner av samtaler, produktbilder og brukeratferd i ett og samme arbeidsområde.

Høres ut som sci-fi, ikke sant? Men plattformer som Databricks MosaicML, Anthropics Claude for data, og OpenAIs GPT-4 Turbo med visjon allerede håndterer datainput i flere formater. Resultatet er kult. Kontekstrik innsikt føles nesten intuitiv. Tenk deg at du kan forutsi feil på utstyret ved å kryssanalysere vibrasjonslogger, termiske bilder og vedlikeholdsnotater. Det er det multimodal analyse muliggjør.

Profftips:

Og den siste på listen over viktige trender innen stordata er beslutningsintelligens (DI). Det blander datavitenskap, DI-systemer kombinerer analyse, psykologi og forretningslogikk for å hjelpe organisasjoner med å ta smartere beslutninger raskere. I stedet for å slenge hundrevis av beregninger etter deg, modellerer DI-systemene hvordan valg fører til resultater, og simulerer deretter scenarier før du forplikter deg.

Tenk på det som en analyse som gir svar på “Hva skjer hvis vi faktisk gjør dette?”, ikke bare “Hva skjedde i forrige kvartal?” Detaljhandlere bruker det til å teste prisstrategier før lansering. Banker bruker det til å simulere risikoeksponering på tvers av porteføljer. Til og med HR-team bruker DI til å forutsi effekten på ansettelser og lojalitet før retningslinjene settes i drift.

Markedet viser dette skiftet: det globale markedet for beslutningsintelligens ble estimert til $15,22 milliarder kroner i 2024 og forventes å nå $36,34 milliarder innen 2030, og vokser med en CAGR på rundt 15,4%.

Profftips:

Så hva er fremtiden for stordata? 2026 bringer med seg et nytt modenhetsnivå. Nå ligger fokuset på å velge verktøy og metoder som faktisk skaper effekt. Virksomheter som kobler teknologi med klare mål, vil oppleve raskere vekst og sterkere resultater.

Bruk AI der det sparer tid og forbedrer nøyaktigheten. Bygg et datanettverk som hjelper teamene med å jobbe sammen i stedet for i siloer. Invester i sanntidsanalyser som hjelper deg med å handle i rett øyeblikk, ikke i etterkant.

Årets ledere forstår én ting: Verdien kommer fra målrettet bruk av data. Velg det som passer til strategien din, få det til å fungere på tvers av teamene, og la data bli motoren som driver alle smarte grep du gjør.

Leder for Big Data og AI

Philip har et skarpt fokus på alt som har med data og AI å gjøre. Han er den som stiller de riktige spørsmålene tidlig, setter en sterk teknisk visjon og sørger for at vi ikke bare bygger smarte systemer - vi bygger de riktige, for å skape reell forretningsverdi.

Meldingen din er sendt.

Vi behandler forespørselen din og kontakter deg så snart som mulig.

Ved å registrere deg godtar du vår Retningslinjer for personvern, inkludert bruk av informasjonskapsler og overføring av dine personopplysninger.